জেমিনি ডেভেলপার এপিআই আপনাকে গুগলের জেমিনি মডেলগুলিতে অ্যাক্সেস দেয়, যার মাধ্যমে আপনি আপনার অ্যান্ড্রয়েড অ্যাপে অত্যাধুনিক জেনারেটিভ এআই ফিচার তৈরি করতে পারেন—যার মধ্যে রয়েছে কথোপকথনমূলক চ্যাট, ছবি তৈরি (ন্যানো ব্যানানার সাহায্যে), এবং টেক্সট, ছবি, অডিও ও ভিডিও ইনপুটের উপর ভিত্তি করে টেক্সট তৈরি।

Gemini Pro এবং Flash মডেলগুলো অ্যাক্সেস করার জন্য, আপনি Firebase AI Logic-এর সাথে Gemini Developer API ব্যবহার করতে পারেন। এটি আপনাকে ক্রেডিট কার্ড ছাড়াই কাজ শুরু করার সুযোগ দেয় এবং একটি আকর্ষণীয় ফ্রি টিয়ার প্রদান করে। অল্প সংখ্যক ব্যবহারকারীর মাধ্যমে আপনার ইন্টিগ্রেশনটি যাচাই করে নেওয়ার পর, আপনি পেইড টিয়ারে আপগ্রেড করে এর পরিধি বাড়াতে পারেন।

শুরু করা হচ্ছে

আপনার অ্যাপ থেকে সরাসরি জেমিনি এপিআই (Gemini API) ব্যবহার করার আগে, আপনাকে প্রথমে কয়েকটি কাজ করতে হবে। এর মধ্যে রয়েছে প্রম্পটিং (promming) সম্পর্কে পরিচিত হওয়া এবং এসডিকে (SDK) ব্যবহারের জন্য ফায়ারবেস (Firebase) ও আপনার অ্যাপকে সেট আপ করা।

প্রম্পট দিয়ে পরীক্ষা করুন

প্রম্পট নিয়ে পরীক্ষা-নিরীক্ষা করলে তা আপনার অ্যান্ড্রয়েড অ্যাপের জন্য সেরা শব্দচয়ন, বিষয়বস্তু এবং বিন্যাস খুঁজে পেতে সাহায্য করতে পারে। গুগল এআই স্টুডিও হলো একটি ইন্টিগ্রেটেড ডেভেলপমেন্ট এনভায়রনমেন্ট (IDE), যা ব্যবহার করে আপনি আপনার অ্যাপের বিভিন্ন ব্যবহারের ক্ষেত্রের জন্য প্রম্পটের প্রোটোটাইপ ও ডিজাইন করতে পারেন।

আপনার ব্যবহারের জন্য কার্যকর প্রম্পট তৈরি করতে ব্যাপক পরীক্ষা-নিরীক্ষার প্রয়োজন হয়, যা এই প্রক্রিয়ার একটি অত্যন্ত গুরুত্বপূর্ণ অংশ। আপনি Firebase ডকুমেন্টেশন থেকে প্রম্পটিং সম্পর্কে আরও জানতে পারবেন।

আপনার প্রম্পটটি পছন্দ হয়ে গেলে, আপনার কোডে যোগ করার জন্য কোড স্নিপেট পেতে <> বোতামটিতে ক্লিক করুন।

একটি ফায়ারবেস প্রজেক্ট তৈরি করুন এবং আপনার অ্যাপটিকে ফায়ারবেসের সাথে সংযুক্ত করুন।

আপনার অ্যাপ থেকে এপিআই (API) কল করার জন্য প্রস্তুত হয়ে গেলে, আপনার অ্যাপে ফায়ারবেস (Firebase) এবং এসডিকে (SDK) সেট আপ করতে ফায়ারবেস এআই লজিক (Firebase AI Logic) গেটিং স্টার্টেড গাইডের "ধাপ ১"-এ দেওয়া নির্দেশাবলী অনুসরণ করুন।

গ্রেডল নির্ভরতা যোগ করুন

আপনার অ্যাপ মডিউলে নিম্নলিখিত গ্রেডল ডিপেন্ডেন্সিটি যোগ করুন:

কোটলিন

dependencies { // ... other androidx dependencies // Import the BoM for the Firebase platform implementation(platform("com.google.firebase:firebase-bom:34.12.0")) // Add the dependency for the Firebase AI Logic library When using the BoM, // you don't specify versions in Firebase library dependencies implementation("com.google.firebase:firebase-ai") }

জাভা

dependencies { // Import the BoM for the Firebase platform implementation(platform("com.google.firebase:34.12.0")) // Add the dependency for the Firebase AI Logic library When using the BoM, // you don't specify versions in Firebase library dependencies implementation("com.google.firebase:firebase-ai") // Required for one-shot operations (to use `ListenableFuture` from Guava // Android) implementation("com.google.guava:guava:31.0.1-android") // Required for streaming operations (to use `Publisher` from Reactive // Streams) implementation("org.reactivestreams:reactive-streams:1.0.4") }

জেনারেটিভ মডেলটি প্রারম্ভিক করুন

প্রথমে একটি GenerativeModel ইনস্ট্যানশিয়েট করুন এবং মডেলের নামটি উল্লেখ করুন:

কোটলিন

// Start by instantiating a GenerativeModel and specifying the model name: val model = Firebase.ai(backend = GenerativeBackend.googleAI()) .generativeModel("gemini-2.5-flash")

জাভা

GenerativeModel firebaseAI = FirebaseAI.getInstance(GenerativeBackend.googleAI()) .generativeModel("gemini-2.5-flash"); GenerativeModelFutures model = GenerativeModelFutures.from(firebaseAI);

জেমিনি ডেভেলপার এপিআই-এর সাথে ব্যবহারের জন্য উপলব্ধ মডেলগুলো সম্পর্কে আরও জানুন। এছাড়াও আপনি মডেল প্যারামিটার কনফিগার করার বিষয়ে আরও জানতে পারেন।

আপনার অ্যাপ থেকে জেমিনি ডেভেলপার এপিআই-এর সাথে ইন্টারঅ্যাক্ট করুন

এখন যেহেতু আপনি SDK ব্যবহার করার জন্য Firebase এবং আপনার অ্যাপ সেট আপ করে ফেলেছেন, আপনি আপনার অ্যাপ থেকে Gemini Developer API-এর সাথে ইন্টারঅ্যাক্ট করার জন্য প্রস্তুত।

টেক্সট তৈরি করুন

টেক্সট প্রতিক্রিয়া তৈরি করতে, আপনার প্রম্পট সহ generateContent() কল করুন।

কোটলিন

scope.launch { val response = model.generateContent("Write a story about a magic backpack.") }

জাভা

Content prompt = new Content.Builder() .addText("Write a story about a magic backpack.") .build(); ListenableFuture<GenerateContentResponse> response = model.generateContent(prompt); Futures.addCallback(response, new FutureCallback<GenerateContentResponse>() { @Override public void onSuccess(GenerateContentResponse result) { String resultText = result.getText(); } @Override public void onFailure(Throwable t) { t.printStackTrace(); } }, executor);

ছবি এবং অন্যান্য মিডিয়া থেকে টেক্সট তৈরি করুন

আপনি একটি প্রম্পট থেকে টেক্সটের সাথে ছবি বা অন্যান্য মিডিয়াও তৈরি করতে পারেন। যখন আপনি generateContent() কল করেন, তখন আপনি মিডিয়াটিকে ইনলাইন ডেটা হিসেবে পাস করতে পারেন।

উদাহরণস্বরূপ, বিটম্যাপ ব্যবহার করতে, image কন্টেন্ট টাইপ ব্যবহার করুন:

কোটলিন

scope.launch { val response = model.generateContent( content { image(bitmap) text("what is the object in the picture?") } ) }

জাভা

Content content = new Content.Builder() .addImage(bitmap) .addText("what is the object in the picture?") .build(); ListenableFuture<GenerateContentResponse> response = model.generateContent(content); Futures.addCallback(response, new FutureCallback<GenerateContentResponse>() { @Override public void onSuccess(GenerateContentResponse result) { String resultText = result.getText(); } @Override public void onFailure(Throwable t) { t.printStackTrace(); } }, executor);

অডিও ফাইল পাস করতে, inlineData কন্টেন্ট টাইপটি ব্যবহার করুন:

কোটলিন

scope.launch { val contentResolver = applicationContext.contentResolver contentResolver.openInputStream(audioUri).use { stream -> stream?.let { val bytes = it.readBytes() val prompt = content { inlineData(bytes, "audio/mpeg") // Specify the appropriate audio MIME type text("Transcribe this audio recording.") } val response = model.generateContent(prompt) } } }

জাভা

ContentResolver resolver = applicationContext.getContentResolver(); try (InputStream stream = resolver.openInputStream(audioUri)) { File audioFile = new File(new URI(audioUri.toString())); int audioSize = (int) audioFile.length(); byte[] audioBytes = new byte[audioSize]; if (stream != null) { stream.read(audioBytes, 0, audioBytes.length); stream.close(); // Provide a prompt that includes audio specified earlier and text Content prompt = new Content.Builder() .addInlineData(audioBytes, "audio/mpeg") // Specify the appropriate audio MIME type .addText("Transcribe what's said in this audio recording.") .build(); // To generate text output, call `generateContent` with the prompt ListenableFuture<GenerateContentResponse> response = model.generateContent(prompt); Futures.addCallback(response, new FutureCallback<GenerateContentResponse>() { @Override public void onSuccess(GenerateContentResponse result) { String text = result.getText(); Log.d(TAG, (text == null) ? "" : text); } @Override public void onFailure(Throwable t) { Log.e(TAG, "Failed to generate a response", t); } }, executor); } else { Log.e(TAG, "Error getting input stream for file."); // Handle the error appropriately } } catch (IOException e) { Log.e(TAG, "Failed to read the audio file", e); } catch (URISyntaxException e) { Log.e(TAG, "Invalid audio file", e); }

এবং একটি ভিডিও ফাইল প্রদান করতে, inlineData কন্টেন্ট টাইপটি ব্যবহার করতে থাকুন:

কোটলিন

scope.launch { val contentResolver = applicationContext.contentResolver contentResolver.openInputStream(videoUri).use { stream -> stream?.let { val bytes = it.readBytes() val prompt = content { inlineData(bytes, "video/mp4") // Specify the appropriate video MIME type text("Describe the content of this video") } val response = model.generateContent(prompt) } } }

জাভা

ContentResolver resolver = applicationContext.getContentResolver(); try (InputStream stream = resolver.openInputStream(videoUri)) { File videoFile = new File(new URI(videoUri.toString())); int videoSize = (int) videoFile.length(); byte[] videoBytes = new byte[videoSize]; if (stream != null) { stream.read(videoBytes, 0, videoBytes.length); stream.close(); // Provide a prompt that includes video specified earlier and text Content prompt = new Content.Builder() .addInlineData(videoBytes, "video/mp4") .addText("Describe the content of this video") .build(); // To generate text output, call generateContent with the prompt ListenableFuture<GenerateContentResponse> response = model.generateContent(prompt); Futures.addCallback(response, new FutureCallback<GenerateContentResponse>() { @Override public void onSuccess(GenerateContentResponse result) { String resultText = result.getText(); System.out.println(resultText); } @Override public void onFailure(Throwable t) { t.printStackTrace(); } }, executor); } } catch (IOException e) { e.printStackTrace(); } catch (URISyntaxException e) { e.printStackTrace(); }

একইভাবে, আপনি প্যারামিটার হিসেবে নিজ নিজ MIME Type উল্লেখ করে PDF ( application/pdf ) এবং প্লেইন টেক্সট ( text/plain ) ডকুমেন্টও পাঠাতে পারেন।

মাল্টি-টার্ন চ্যাট

আপনি একাধিক পালায় কথোপকথনও সমর্থন করতে পারেন। startChat() ফাংশন ব্যবহার করে একটি চ্যাট শুরু করুন। আপনি চাইলে মডেলটিকে মেসেজ হিস্ট্রি প্রদান করতে পারেন। এরপর চ্যাট মেসেজ পাঠানোর জন্য sendMessage() ফাংশনটি কল করুন।

কোটলিন

val chat = model.startChat( history = listOf( content(role = "user") { text("Hello, I have 2 dogs in my house.") }, content(role = "model") { text("Great to meet you. What would you like to know?") } ) ) scope.launch { val response = chat.sendMessage("How many paws are in my house?") }

জাভা

Content.Builder userContentBuilder = new Content.Builder(); userContentBuilder.setRole("user"); userContentBuilder.addText("Hello, I have 2 dogs in my house."); Content userContent = userContentBuilder.build(); Content.Builder modelContentBuilder = new Content.Builder(); modelContentBuilder.setRole("model"); modelContentBuilder.addText("Great to meet you. What would you like to know?"); Content modelContent = modelContentBuilder.build(); List<Content> history = Arrays.asList(userContent, modelContent); // Initialize the chat ChatFutures chat = model.startChat(history); // Create a new user message Content.Builder messageBuilder = new Content.Builder(); messageBuilder.setRole("user"); messageBuilder.addText("How many paws are in my house?"); Content message = messageBuilder.build(); // Send the message ListenableFuture<GenerateContentResponse> response = chat.sendMessage(message); Futures.addCallback(response, new FutureCallback<GenerateContentResponse>() { @Override public void onSuccess(GenerateContentResponse result) { String resultText = result.getText(); System.out.println(resultText); } @Override public void onFailure(Throwable t) { t.printStackTrace(); } }, executor);

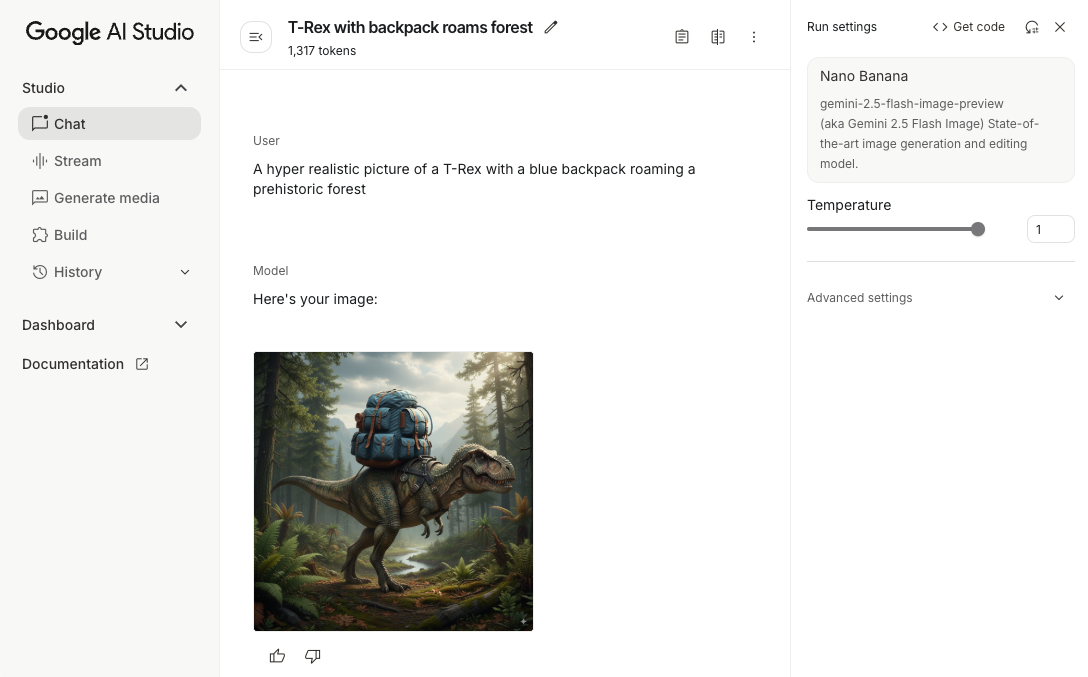

ন্যানো ব্যানানা দিয়ে অ্যান্ড্রয়েডে ছবি তৈরি করুন

জেমিনি ২.৫ ফ্ল্যাশ ইমেজ মডেল (যা ন্যানো ব্যানানা নামেও পরিচিত) বিশ্ব জ্ঞান এবং যুক্তিবোধকে কাজে লাগিয়ে ছবি তৈরি ও সম্পাদনা করতে পারে। এটি প্রসঙ্গ অনুযায়ী প্রাসঙ্গিক ছবি তৈরি করে এবং টেক্সট ও ছবির আউটপুটকে নির্বিঘ্নে মিশ্রিত বা একের পর এক সাজিয়ে দেয়। এটি দীর্ঘ টেক্সট অনুক্রম ব্যবহার করে নির্ভুল ভিজ্যুয়ালও তৈরি করতে পারে এবং প্রসঙ্গ বজায় রেখে কথোপকথনমূলক ছবি সম্পাদনা সমর্থন করে।

জেমিনির বিকল্প হিসেবে আপনি ইমাজেন মডেলগুলো ব্যবহার করতে পারেন, বিশেষ করে উচ্চ-মানের ছবি তৈরির জন্য যেখানে ফটোরিয়ালিজম, শৈল্পিক বিবরণ বা নির্দিষ্ট স্টাইলের প্রয়োজন হয়। তবে, অ্যান্ড্রয়েড অ্যাপের বেশিরভাগ ক্লায়েন্ট-সাইড ব্যবহারের ক্ষেত্রে জেমিনিই যথেষ্টের চেয়েও বেশি হবে।

এই নির্দেশিকায় অ্যান্ড্রয়েডের জন্য ফায়ারবেস এআই লজিক এসডিকে ব্যবহার করে জেমিনি ২.৫ ফ্ল্যাশ ইমেজ মডেল (ন্যানো ব্যানানা) কীভাবে ব্যবহার করতে হয় তা বর্ণনা করা হয়েছে। জেমিনি দিয়ে ইমেজ তৈরি করার বিষয়ে আরও বিস্তারিত জানতে, ফায়ারবেসে জেমিনি দিয়ে ইমেজ তৈরি করুন ডকুমেন্টেশনটি দেখুন। আপনি যদি ইমেজেন মডেল ব্যবহার করতে আগ্রহী হন, তাহলে ডকুমেন্টেশনটি দেখুন।

জেনারেটিভ মডেলটি প্রারম্ভিক করুন

একটি GenerativeModel ইনস্ট্যানশিয়েট করুন এবং gemini-2.5-flash-image-preview মডেলের নামটি নির্দিষ্ট করুন। যাচাই করুন যে আপনি responseModalities TEXT এবং IMAGE উভয়ই অন্তর্ভুক্ত করে কনফিগার করেছেন।

কোটলিন

val model = Firebase.ai(backend = GenerativeBackend.googleAI()).generativeModel( modelName = "gemini-2.5-flash-image-preview", // Configure the model to respond with text and images (required) generationConfig = generationConfig { responseModalities = listOf( ResponseModality.TEXT, ResponseModality.IMAGE ) } )

জাভা

GenerativeModel ai = FirebaseAI.getInstance(GenerativeBackend.googleAI()).generativeModel( "gemini-2.5-flash-image-preview", // Configure the model to respond with text and images (required) new GenerationConfig.Builder() .setResponseModalities(Arrays.asList(ResponseModality.TEXT, ResponseModality.IMAGE)) .build() ); GenerativeModelFutures model = GenerativeModelFutures.from(ai);

ছবি তৈরি করুন (শুধুমাত্র টেক্সট ইনপুট)

আপনি শুধুমাত্র টেক্সট-ভিত্তিক প্রম্পট প্রদান করে একটি জেমিনি মডেলকে ছবি তৈরি করার নির্দেশ দিতে পারেন:

কোটলিন

scope.launch { // Provide a text prompt instructing the model to generate an image val prompt = "A hyper realistic picture of a t-rex with a blue bag pack roaming a pre-historic forest." // To generate image output, call `generateContent` with the text input val generatedImageAsBitmap: Bitmap? = model.generateContent(prompt) .candidates.first().content.parts.filterIsInstance<ImagePart>() .firstOrNull()?.image }

জাভা

// Provide a text prompt instructing the model to generate an image Content prompt = new Content.Builder() .addText("Generate an image of the Eiffel Tower with fireworks in the background.") .build(); // To generate an image, call `generateContent` with the text input ListenableFuture<GenerateContentResponse> response = model.generateContent(prompt); Futures.addCallback(response, new FutureCallback<GenerateContentResponse>() { @Override public void onSuccess(GenerateContentResponse result) { // iterate over all the parts in the first candidate in the result object for (Part part : result.getCandidates().get(0).getContent().getParts()) { if (part instanceof ImagePart) { ImagePart imagePart = (ImagePart) part; // The returned image as a bitmap Bitmap generatedImageAsBitmap = imagePart.getImage(); break; } } } @Override public void onFailure(Throwable t) { t.printStackTrace(); } }, executor);

ছবি সম্পাদনা করুন (টেক্সট এবং ছবি ইনপুট)

আপনি আপনার অনুরোধে টেক্সট এবং এক বা একাধিক ছবি উভয়ই প্রদান করে একজন জেমিনি মডেলকে বিদ্যমান ছবি সম্পাদনা করতে বলতে পারেন:

কোটলিন

scope.launch { // Provide a text prompt instructing the model to edit the image val prompt = content { image(bitmap) text("Edit this image to make it look like a cartoon") } // To edit the image, call `generateContent` with the prompt (image and text input) val generatedImageAsBitmap: Bitmap? = model.generateContent(prompt) .candidates.first().content.parts.filterIsInstance<ImagePart>().firstOrNull()?.image // Handle the generated text and image }

জাভা

// Provide an image for the model to edit Bitmap bitmap = BitmapFactory.decodeResource(resources, R.drawable.scones); // Provide a text prompt instructing the model to edit the image Content promptcontent = new Content.Builder() .addImage(bitmap) .addText("Edit this image to make it look like a cartoon") .build(); // To edit the image, call `generateContent` with the prompt (image and text input) ListenableFuture<GenerateContentResponse> response = model.generateContent(promptcontent); Futures.addCallback(response, new FutureCallback<GenerateContentResponse>() { @Override public void onSuccess(GenerateContentResponse result) { // iterate over all the parts in the first candidate in the result object for (Part part : result.getCandidates().get(0).getContent().getParts()) { if (part instanceof ImagePart) { ImagePart imagePart = (ImagePart) part; Bitmap generatedImageAsBitmap = imagePart.getImage(); break; } } } @Override public void onFailure(Throwable t) { t.printStackTrace(); } }, executor);

মাল্টি-টার্ন চ্যাটের মাধ্যমে ছবিগুলো পুনরাবৃত্তি করুন এবং সম্পাদনা করুন।

ছবি সম্পাদনার ক্ষেত্রে কথোপকথনমূলক পদ্ধতির জন্য, আপনি মাল্টি-টার্ন চ্যাট ব্যবহার করতে পারেন। এর মাধ্যমে মূল ছবিটি পুনরায় না পাঠিয়েই সম্পাদনা আরও নিখুঁত করার জন্য পরবর্তী অনুরোধ জানানো যায়।

প্রথমে, startChat() ব্যবহার করে একটি চ্যাট শুরু করুন, ঐচ্ছিকভাবে মেসেজ হিস্ট্রিও যোগ করতে পারেন। তারপর, পরবর্তী মেসেজগুলোর জন্য sendMessage() ব্যবহার করুন:

কোটলিন

scope.launch { // Create the initial prompt instructing the model to edit the image val prompt = content { image(bitmap) text("Edit this image to make it look like a cartoon") } // Initialize the chat val chat = model.startChat() // To generate an initial response, send a user message with the image and text prompt var response = chat.sendMessage(prompt) // Inspect the returned image var generatedImageAsBitmap: Bitmap? = response .candidates.first().content.parts.filterIsInstance<ImagePart>().firstOrNull()?.image // Follow up requests do not need to specify the image again response = chat.sendMessage("But make it old-school line drawing style") generatedImageAsBitmap = response .candidates.first().content.parts.filterIsInstance<ImagePart>().firstOrNull()?.image }

জাভা

// Provide an image for the model to edit Bitmap bitmap = BitmapFactory.decodeResource(resources, R.drawable.scones); // Initialize the chat ChatFutures chat = model.startChat(); // Create the initial prompt instructing the model to edit the image Content prompt = new Content.Builder() .setRole("user") .addImage(bitmap) .addText("Edit this image to make it look like a cartoon") .build(); // To generate an initial response, send a user message with the image and text prompt ListenableFuture<GenerateContentResponse> response = chat.sendMessage(prompt); // Extract the image from the initial response ListenableFuture<Bitmap> initialRequest = Futures.transform(response, result -> { for (Part part : result.getCandidates().get(0).getContent().getParts()) { if (part instanceof ImagePart) { ImagePart imagePart = (ImagePart) part; return imagePart.getImage(); } } return null; }, executor); // Follow up requests do not need to specify the image again ListenableFuture<GenerateContentResponse> modelResponseFuture = Futures.transformAsync( initialRequest, generatedImage -> { Content followUpPrompt = new Content.Builder() .addText("But make it old-school line drawing style") .build(); return chat.sendMessage(followUpPrompt); }, executor); // Add a final callback to check the reworked image Futures.addCallback(modelResponseFuture, new FutureCallback<GenerateContentResponse>() { @Override public void onSuccess(GenerateContentResponse result) { for (Part part : result.getCandidates().get(0).getContent().getParts()) { if (part instanceof ImagePart) { ImagePart imagePart = (ImagePart) part; Bitmap generatedImageAsBitmap = imagePart.getImage(); break; } } } @Override public void onFailure(Throwable t) { t.printStackTrace(); } }, executor);

বিবেচ্য বিষয় এবং সীমাবদ্ধতা

নিম্নলিখিত বিবেচ্য বিষয় ও সীমাবদ্ধতাগুলো লক্ষ্য করুন:

- আউটপুট ফরম্যাট : ছবিগুলো সর্বোচ্চ ১০২৪ পিক্সেল ডাইমেনশন সহ PNG ফরম্যাটে তৈরি হয়।

- ইনপুট প্রকার : মডেলটি ছবি তৈরির জন্য অডিও বা ভিডিও ইনপুট সমর্থন করে না।

- ভাষা সমর্থন : সর্বোত্তম পারফরম্যান্সের জন্য, নিম্নলিখিত ভাষাগুলি ব্যবহার করুন: ইংরেজি (

en), মেক্সিকান স্প্যানিশ (es-mx), জাপানি (ja-jp), সরলীকৃত চীনা (zh-cn), এবং হিন্দি (hi-in)। - প্রজন্মগত সমস্যা :

- ছবি তৈরি হওয়া সবসময় চালু নাও হতে পারে, যার ফলে কখনও কখনও শুধু টেক্সট আউটপুট আসতে পারে। স্পষ্টভাবে ছবির আউটপুটের জন্য অনুরোধ করার চেষ্টা করুন (উদাহরণস্বরূপ, "একটি ছবি তৈরি করুন", "কাজ করার সাথে সাথে ছবি দিন", "ছবিটি আপডেট করুন")।

- মডেলটি তৈরি হওয়ার মাঝপথে থেমে যেতে পারে। আবার চেষ্টা করুন অথবা অন্য কোনো প্রম্পট ব্যবহার করুন ।

- মডেলটি টেক্সটকে একটি ছবি হিসেবে তৈরি করতে পারে। স্পষ্টভাবে টেক্সট আউটপুটের জন্য অনুরোধ করে দেখুন (উদাহরণস্বরূপ, "চিত্রসহ বর্ণনামূলক টেক্সট তৈরি করুন")।

আরও বিস্তারিত জানতে ফায়ারবেস ডকুমেন্টেশন দেখুন।

পরবর্তী পদক্ষেপ

আপনার অ্যাপটি সেট আপ করার পরে, নিম্নলিখিত পরবর্তী পদক্ষেপগুলি বিবেচনা করুন:

- গিটহাবে থাকা অ্যান্ড্রয়েড কুইকস্টার্ট ফায়ারবেস স্যাম্পল অ্যাপ এবং অ্যান্ড্রয়েড এআই স্যাম্পল ক্যাটালগটি পর্যালোচনা করুন।

- অননুমোদিত ক্লায়েন্টদের অপব্যবহার থেকে জেমিনি এপিআই-কে সুরক্ষিত রাখতে ফায়ারবেস অ্যাপ চেক সেট আপ করা সহ আপনার অ্যাপটিকে প্রোডাকশনের জন্য প্রস্তুত করুন ।

- Firebase ডকুমেন্টেশনে Firebase AI Logic সম্পর্কে আরও জানুন।