10 月に、Samsung は Android XR を搭載した初のデバイスである Galaxy XR をリリースしました。皆様がどのようなものを構築されているかを見るのは、とても素晴らしいことです。Android XR への取り組みについて、デベロッパーの皆様から寄せられた声をご紹介します。

Android XR は、アプリを構築するためのまったく新しい世界を提供してくれました。チームは、自分たちに問いかける必要があります。「自分たちが構築できるエクスペリエンスの最大かつ大胆なバージョンとは何か?」このプラットフォームを使えば、これまでやりたかったことを実現できます。- Calm、リード プロダクト マネージャー、Kristen Coke

また、XREAL の Project Aura や Gentle Monster と Warby Parker のスタイリッシュなメガネなど、Android XR と連携する他のデバイスのプレビューも公開しました。

XR デバイスの選択肢の拡大に対応するため、Android XR SDK デベロッパー プレビュー 3 を発表します。

Android XR SDK デベロッパー プレビュー 3 では、Galaxy XR などのデバイス向けの没入型エクスペリエンスの構築に加えて、Android XR を使用した今後の AI グラス向けの拡張エクスペリエンスも構築できるようになりました。

拡張エクスペリエンスのための新しいツールとライブラリ

デベロッパー プレビュー 3 では、AI グラス向けのインテリジェントでハンズフリーの拡張エクスペリエンスを構築するために必要なツールとライブラリが利用できるようになります。AI グラスは軽量で持ち運びやすく、一日中装着できます。既存のモバイルアプリを拡張して、内蔵のスピーカー、カメラ、マイクを活用し、新しい、思慮深く、役立つユーザー インタラクションを提供できます。ディスプレイ AI グラスに小型ディスプレイを追加することで、ユーザーに情報を非公開で提示できます。AI グラスは、ユーザーが現実世界で集中力と存在感を高めるのに役立つエクスペリエンスに最適です。

AI グラスで拡張エクスペリエンスを実現するため、Jetpack XR SDK に 2 つの新しい専用ライブラリを導入します。

- Jetpack Projected - モバイル デバイスと AI グラスを橋渡しするために構築され、グラスのセンサー、スピーカー、ディスプレイにアクセスできる機能を提供します。

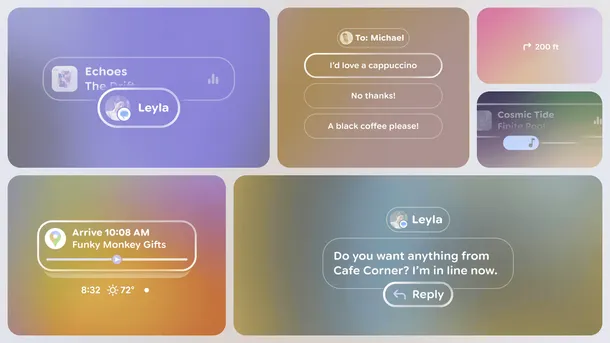

- Jetpack Compose Glimmer - ディスプレイ AI グラスで拡張現実体験を作成し、スタイルを設定するための新しいデザイン言語と UI コンポーネント

Jetpack Compose Glimmer は、美しく光学的に透過する拡張現実エクスペリエンスを実現するための設計のベスト プラクティスを示すデモです。ディスプレイ AI グラスの入力モードとスタイリングの要件に合わせて最適化された UI コンポーネントを備えた Jetpack Compose Glimmer は、明瞭さ、読みやすさ、最小限の注意散漫を目的として設計されています。

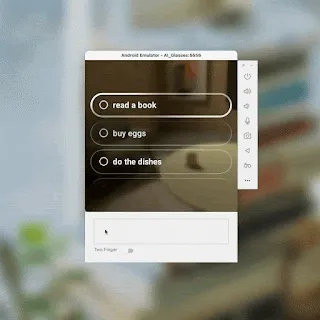

Jetpack Compose Glimmer UI の可視化とテストを支援するため、Android Studio に AI グラス エミュレータを導入します。新しい AI グラス エミュレータでは、タッチパッドや音声入力など、グラス固有の操作をシミュレートできます。

新しい Jetpack Projected ライブラリと Jetpack Compose Glimmer ライブラリに加えて、ARCore for Jetpack XR を拡張して AI グラスをサポートします。まず、拡張エクスペリエンス向けのモーション トラッキングと地理空間機能から始めます。これらは、AI グラスのような一日中装着できるデバイスに最適な、便利なナビゲーション エクスペリエンスを作成できる機能です。

没入型エクスペリエンスのサポートを拡大

Google は、Samsung Galaxy XR などの XR ヘッドセットや、XREAL の Project Aura などの有線 XR グラスの没入型エクスペリエンスを強化するライブラリとツールに引き続き投資していきます。デベロッパー プレビュー 2 以降、皆様からのフィードバックを参考に、Jetpack XR SDK にご要望の多かった機能をいくつか追加しました。

Jetpack SceneCore では、URI を介した動的な glTF モデルの読み込みと、実行時に新しい PBR マテリアルを作成するためのマテリアルのサポートの改善が導入されました。また、SurfaceEntity コンポーネントが完全な Widevine デジタル著作権管理(DRM)のサポートと新しいシェイプで強化され、球体と半球で360 度と 180 度の動画をレンダリングできるようになりました。

Jetpack Compose for XR では、フォロー動作用の UserSubspace コンポーネントなどの新機能が提供されており、ユーザーがどこを見てもコンテンツがユーザーの視野内に収まるようになっています。また、スライドやフェードなどのスムーズなトランジションに空間アニメーションを使用できるようになりました。また、多様なディスプレイ機能を備えた没入型デバイスのエコシステムの拡大をサポートするため、ユーザーの快適な視野の割合としてレイアウト サイズを指定できるようになりました。

マテリアル デザイン for XR では、新しいコンポーネントはオーバーライドによって自動的に空間的に適応します。これには、空間的に浮き上がるダイアログや、オービターに飛び出すナビゲーション バーなどがあります。また、フルスペースへの切り替えを簡単に行うための新しい SpaceToggleButton コンポーネントもあります。

また、ARCore for Jetpack XR では、68 個のブレンドシェイプ値による顔追跡など、新しい認識機能が追加され、顔のジェスチャーの世界が広がります。また、アイ トラッキングを使用してバーチャル アバターを操作したり、深度マップを使用してユーザーの環境とのよりリアルなインタラクションを実現したりすることもできます。

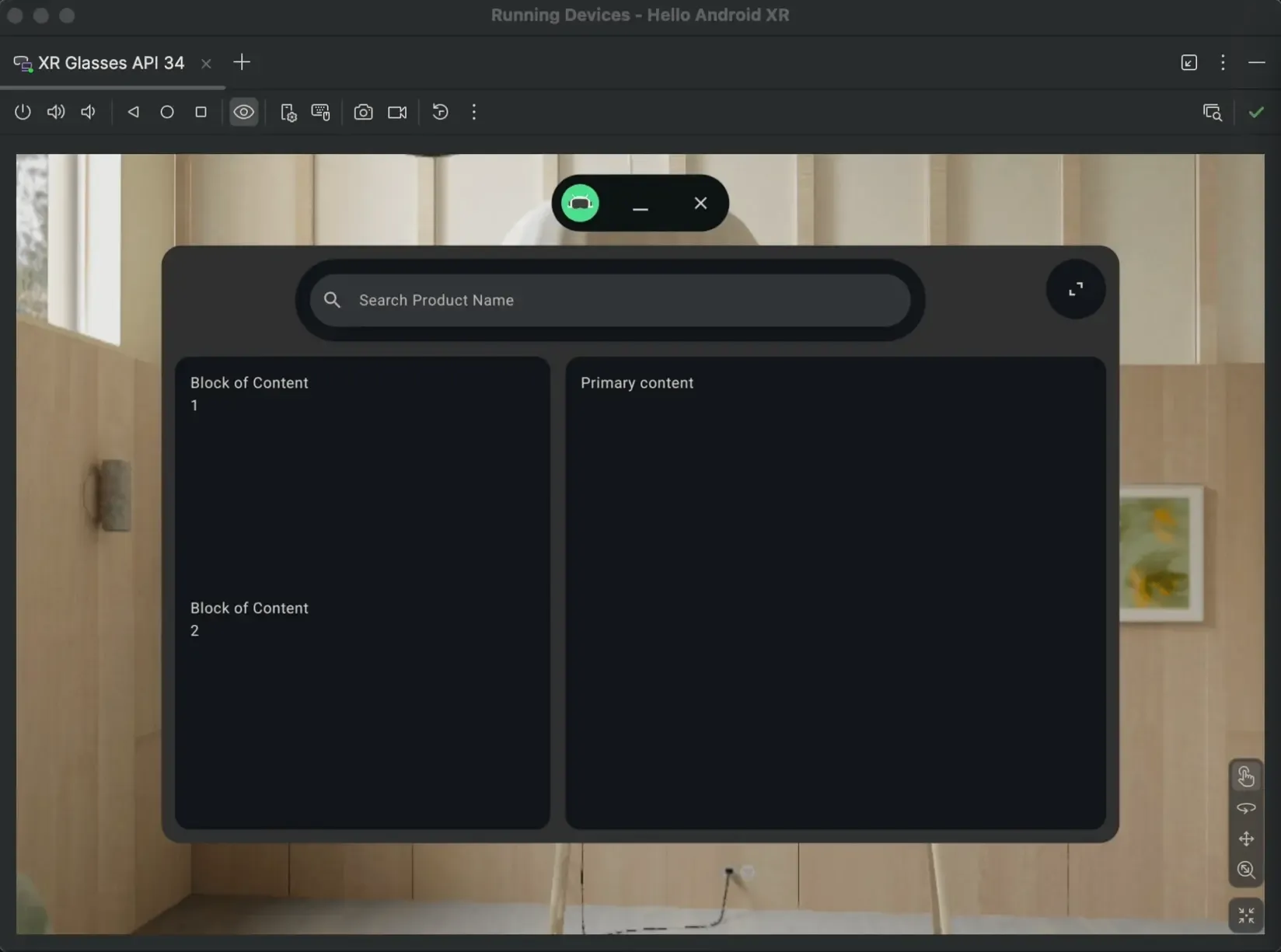

XREAL の Project Aura などのデバイス向けに、Android Studio に XR グラス エミュレータを導入します。この重要なツールは、視野(FoV)、解像度、DPI の実際のデバイス仕様に合わせて、正確なコンテンツの可視化を実現し、開発を加速するように設計されています。

Unity で没入型エクスペリエンスを構築している場合は、Unity 向け Android XR SDK で認識機能も拡張されます。バグの修正やその他の改善に加えて、QR コードと ArUco コード、平面画像、ボディ トラッキング(試験運用版)など、トラッキング機能を拡張しています。また、ご要望の多かったシーン メッシュ機能も導入します。これにより、ユーザーの環境とのインタラクションが大幅に深まります。デジタル コンテンツが壁に跳ね返ったり、ソファを登ったりできるようになりました。

これらはほんの一部です。詳しくは、没入型コンテンツのページをご覧ください。

お問い合わせ

Android XR SDK デベロッパー プレビュー 3 が本日リリースされました。最新の Android Studio Canary(Otter 3、Canary 4 以降)をダウンロードして、最新のエミュレータ バージョン(36.4.3 Canary 以降)にアップグレードし、developer.android.com/xr にアクセスして、Android XR デバイスの選択肢を増やすために必要な最新のライブラリとサンプルを入手してください。Android XR は皆様とともに構築しています。Android XR の開発を進めるうえで、フィードバック、提案、アイデアをチームと共有することを忘れないでください。

続きを読む

-

プロダクト ニュース

本日、複雑な推論と自律的なツール呼び出し機能を備えた最新の最先端オープンモデルである Gemma 4 を使用して、Android 開発を強化します。

Matthew McCullough • 所要時間: 2 分

-

プロダクト ニュース

Android 17 は本日、ベータ版 3 で正式にプラットフォームの安定版に到達しました。つまり、API サーフェスがロックされ、最終的な互換性テストを実施して、Android 17 をターゲットとするアプリを Google Play ストアにプッシュできるようになります。

Matthew McCullough • 所要時間: 5 分

-

プロダクト ニュース

Google は、高品質の Android アプリをより迅速かつ簡単に構築できるようにしたいと考えています。生産性を高めるための方法の一つとして、AI を活用しています。

Matthew McCullough • 所要時間: 2 分

メールを受け取る

Android 開発に関する最新の分析情報を毎週メールでお届けします。