Actualités des produits

Créez des applications plus intelligentes avec Gemini 3 Flash

Temps de lecture : 2 min

Aujourd'hui, nous élargissons la famille de modèles Gemini 3 avec le lancement de Gemini 3 Flash, une intelligence de pointe conçue pour la rapidité à un coût bien inférieur. Vous pouvez commencer à l'utiliser immédiatement, car nous lançons officiellement Gemini 3 Flash sur Firebase AI Logic. Disponible dans le monde entier, vous pouvez accéder de manière sécurisée au modèle Gemini 3 Flash en preview directement depuis votre application via l'API Gemini Developer ou l'API Vertex AI Gemini à l'aide des SDK client Firebase AI Logic. Les excellentes performances de Gemini 3 Flash en termes de raisonnement, d'utilisation d'outils et de capacités multimodales sont idéales pour les développeurs qui souhaitent effectuer des analyses vidéo, des extractions de données et des questions/réponses visuelles plus complexes.

Gemini 3 optimisé pour une faible latence

Gemini 3 est notre famille de modèles la plus intelligente à ce jour. Avec le lancement de Gemini 3 Flash, nous rendons cette intelligence plus accessible pour les cas d'utilisation à faible latence et rentables. Alors que Gemini 3 Pro est conçu pour le raisonnement complexe, Gemini 3 Flash est conçu pour être beaucoup plus rapide et plus rentable pour vos applications de production.

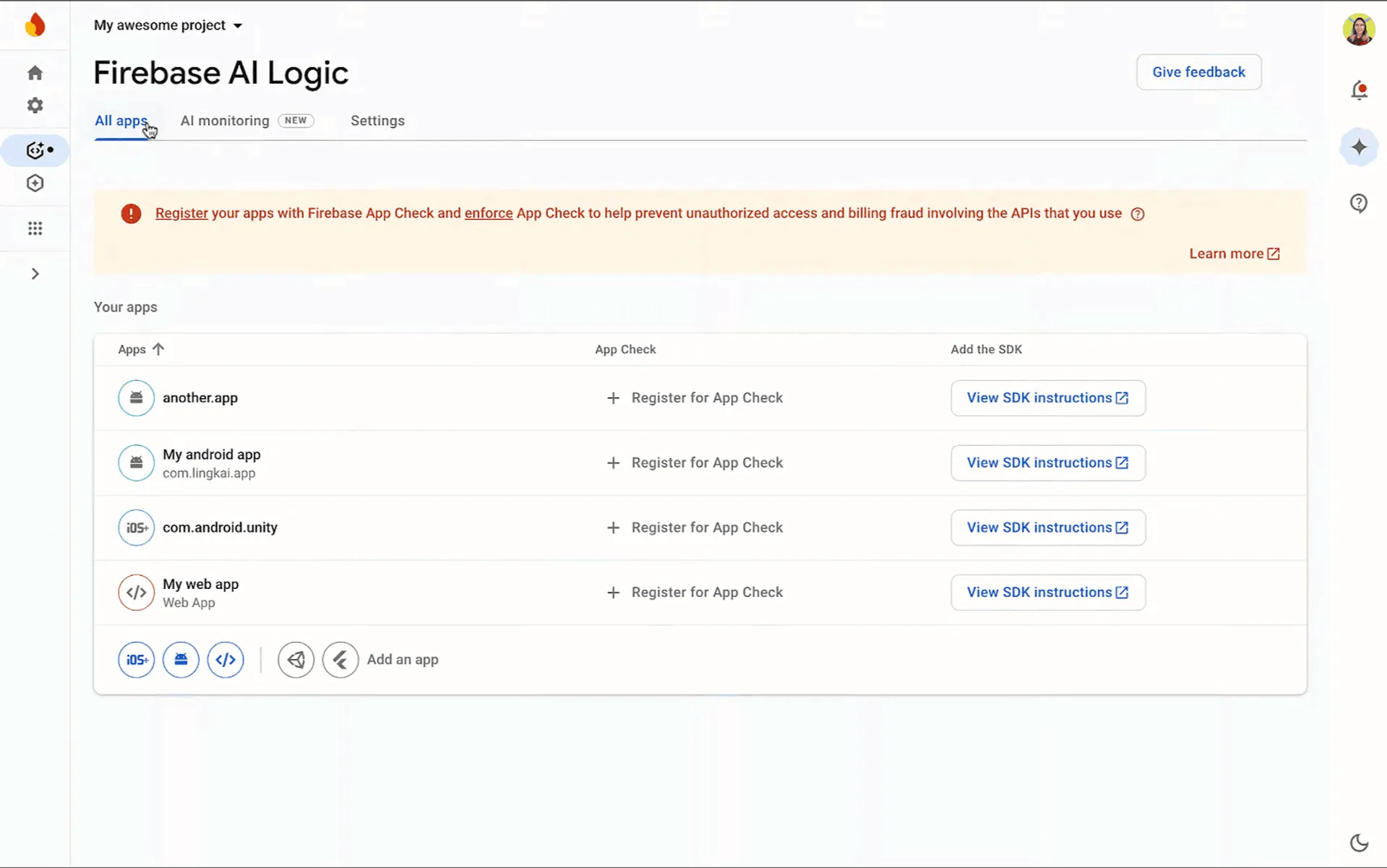

Intégration parfaite à Firebase AI Logic

Comme le modèle Pro, Gemini 3 Flash est disponible en aperçu directement via le SDK Firebase AI Logic. Cela signifie que vous pouvez l'intégrer à votre application Android sans avoir à effectuer de configuration complexe côté serveur.

Voici comment l'ajouter à votre code Kotlin :

val model = Firebase.ai(backend = GenerativeBackend.googleAI()) .generativeModel(modelName = "gemini-3-flash-preview")

Évoluer en toute confiance

De plus, Firebase vous permet de sécuriser et de gérer votre croissance grâce aux fonctionnalités suivantes :

AI Monitoring

Le tableau de bord Firebase AI Monitoring vous permet de visualiser la latence, les taux de réussite et les coûts. Vous pouvez segmenter les données par nom de modèle pour voir exactement comment le modèle fonctionne.

Modèles de requêtes de serveur

Vous pouvez utiliser des modèles de prompts côté serveur pour stocker votre prompt et votre schéma de manière sécurisée sur les serveurs Firebase au lieu de les coder en dur dans le binaire de votre application. Cette fonctionnalité garantit la sécurité de vos requêtes sensibles, empêche l'extraction non autorisée de requêtes et permet une itération plus rapide sans nécessiter de mises à jour de l'application.

--- model: 'gemini-3-flash-preview' input: schema: topic: type: 'string' minLength: 2 maxLength: 40 length: type: 'number' minimum: 1 maximum: 200 language: type: 'string' —-- {{role "system"}} You're a storyteller that tells nice and joyful stories with happy endings. {{role "user"}} Create a story about {{topic}} with the length of {{length}} words in the {{language}} language.

Modèle de prompt côté serveur défini à l'aide de la console Firebase

val generativeModel = Firebase.ai.templateGenerativeModel() val response = generativeModel.generateContent("storyteller-v10", mapOf( "topic" to topic, "length" to length, "language" to language ) ) _output.value = response.text

Extrait de code permettant d'accéder au modèle d'invite du serveur

Gemini 3 Flash pour l'aide au développement de l'IA dans Android Studio

Gemini 3 Flash est également disponible pour l'assistance IA dans Android Studio. Alors que Gemini 3 Pro Preview est notre meilleur modèle pour le codage et les expériences agentiques, Gemini 3 Flash est conçu pour la rapidité et est idéal pour les tâches et questions de développement courantes.

Le nouveau modèle est déployé dès aujourd'hui pour les développeurs qui utilisent Gemini dans Android Studio sans frais (modèle par défaut). Pour bénéficier de limites de débit plus élevées et de sessions plus longues avec le mode Agent, vous pouvez utiliser une clé API AI Studio afin d'exploiter toutes les fonctionnalités de Gemini 3 Flash ou Gemini 3 Pro. Nous déployons également l'accès à la famille de modèles Gemini 3 avec des limites de taux d'utilisation plus élevées pour les développeurs disposant de licences Gemini Code Assist Standard ou Enterprise. Votre administrateur informatique devra activer l'accès aux modèles d'aperçu dans la console Google Cloud.

Commencez dès maintenant

Vous pouvez commencer à tester Gemini 3 Flash avec Firebase AI Logic dès aujourd'hui. Pour en savoir plus, consultez la documentation Android et la documentation Firebase. Essayez l'un des nouveaux modèles Gemini 3 dans Android Studio pour obtenir de l'aide au développement et dites-nous ce que vous en pensez ! Comme toujours, vous pouvez nous suivre sur LinkedIn, notre blog, YouTube et X.

Lire la suite

-

Actualités des produits

L'ajout d'images personnalisées à votre application peut améliorer et personnaliser considérablement l'expérience utilisateur, et accroître l'engagement des utilisateurs.

Thomas Ezan, Mozart Louis • Temps de lecture : 5 min

-

Actualités des produits

Proposer l'expérience Google Play la plus sécurisée et la plus fiable possible. Aujourd'hui, nous annonçons un nouvel ensemble de modifications des règles et une fonctionnalité de transfert de compte pour renforcer la confidentialité des utilisateurs et protéger votre entreprise contre la fraude.

Bennet Manuel • Temps de lecture : 3 min

-

Actualités des produits

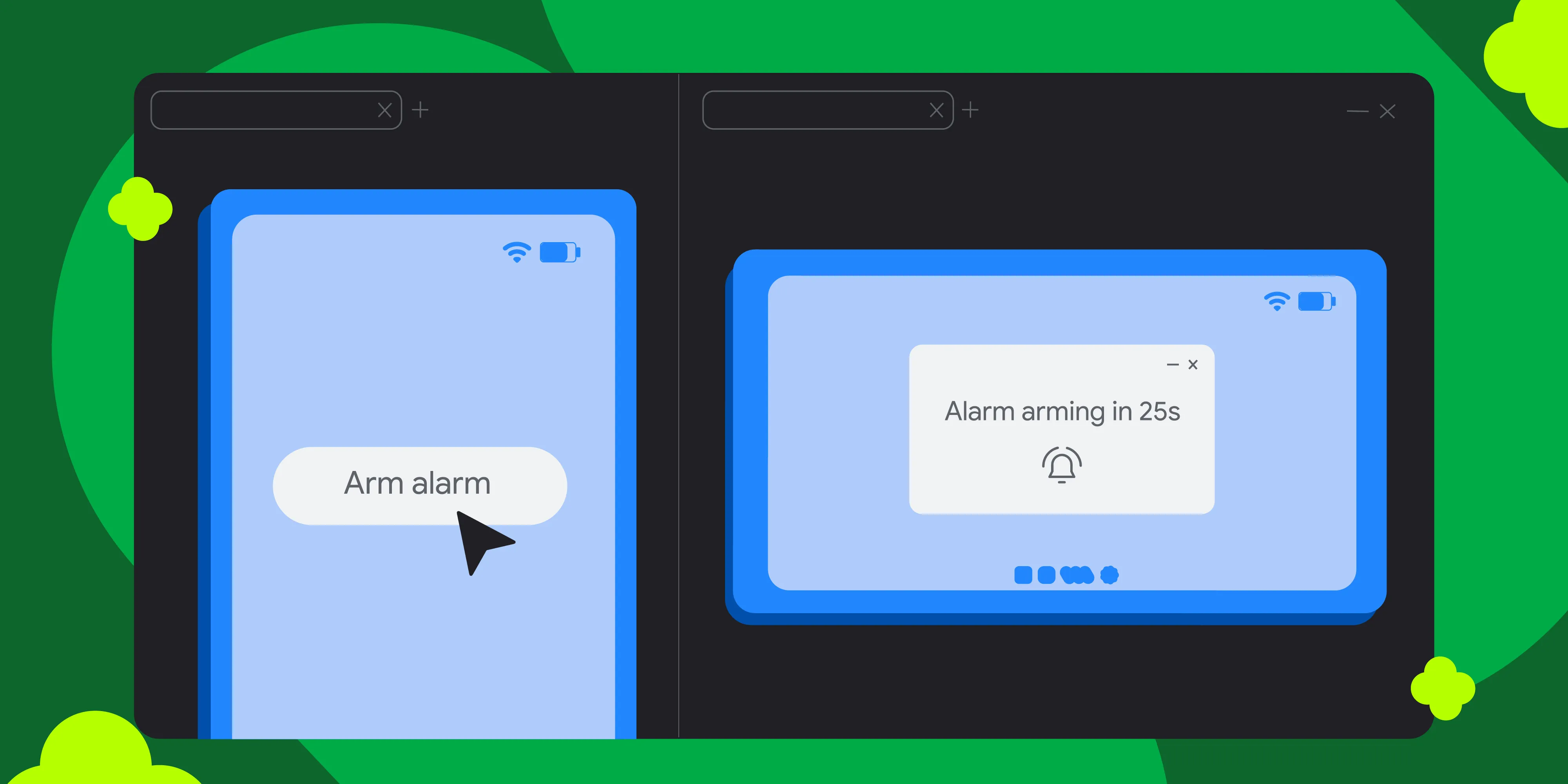

Il n'a jamais été aussi simple de tester les interactions multi-appareils avec l'émulateur Android.

Steven Jenkins • Temps de lecture : 2 min

Restez informé

Recevez chaque semaine les dernières informations sur le développement Android directement dans votre boîte de réception.