חדשות על מוצרים

שיפור פיתוח אפליקציות ל-Android בעזרת AI ושיפור מודלים גדולים של שפה (LLM) באמצעות Android Bench

משך הקריאה: 2 דקות

אנחנו רוצים לעזור לכם ליצור אפליקציות ל-Android באיכות גבוהה בצורה מהירה וקלה יותר, ואחת הדרכים שבהן אנחנו עוזרים לכם לשפר את הפרודוקטיביות היא באמצעות AI. אנחנו יודעים שאתם רוצים AI שמבין באמת את הניואנסים של פלטפורמת Android, ולכן אנחנו בודקים את הביצועים של מודלים גדולים של שפה (LLM) במשימות פיתוח ל-Android. היום השקנו את הגרסה הראשונה של Android Bench, טבלת המובילים הרשמית שלנו של מודלים גדולים של שפה (LLM) לפיתוח ל-Android.

המטרה שלנו היא לספק ליוצרי מודלים נקודת השוואה להערכת היכולות של מודלים גדולים של שפה (LLM) לפיתוח אפליקציות ל-Android. אנחנו עוזרים ליוצרי מודלים לזהות פערים ולשפר את המודלים שלהם מהר יותר, על ידי יצירת בסיס ברור ומהימן להגדרת פיתוח באיכות גבוהה ל-Android. כך המפתחים יכולים לעבוד בצורה יעילה יותר עם מגוון רחב יותר של מודלים מועילים של AI. בסופו של דבר, זה יוביל לאפליקציות באיכות גבוהה יותר בכל האקוסיסטם של Android.

מיועד למשימות פיתוח אמיתיות ל-Android

יצרנו את המדד על ידי אוסף של משימות במגוון תחומים נפוצים בפיתוח ל-Android. הוא מורכב מאתגרים אמיתיים ברמות קושי שונות, שנלקחו ממאגרי Android ציבוריים ב-GitHub. התרחישים כוללים פתרון של שינויים שעלולים לגרום לכשל בין גרסאות Android, משימות ספציפיות לדומיין כמו רישות במכשירים לבישים, ומעבר לגרסה העדכנית של Jetpack פיתוח נייטיב.

בכל הערכה, מודל LLM מנסה לתקן את הבעיה שדווחה במשימה, ואנחנו מאמתים את התיקון באמצעות בדיקות יחידה או בדיקות מכשור. הגישה הזו לא תלויה במודל, ולכן היא מאפשרת לנו למדוד את היכולת של המודל לנווט בבסיסי קוד מורכבים, להבין תלויות ולפתור את סוג הבעיות שאתם נתקלים בהן מדי יום.

אימתנו את המתודולוגיה הזו עם כמה יוצרי LLM, כולל JetBrains.

“מדידת ההשפעה של AI על Android היא אתגר עצום, ולכן נהדר לראות מסגרת שהיא כל כך הגיונית ומציאותית. אנחנו משתמשים באופן פעיל בהשוואה לשוק, אבל Android Bench הוא תוספת ייחודית ומבורכת. המתודולוגיה הזו היא בדיוק סוג ההערכה הקפדנית שמפתחי Android צריכים כרגע".

– קיריל סמילוב (Kirill Smelov), ראש תחום שילובי ה-AI ב-JetBrains.

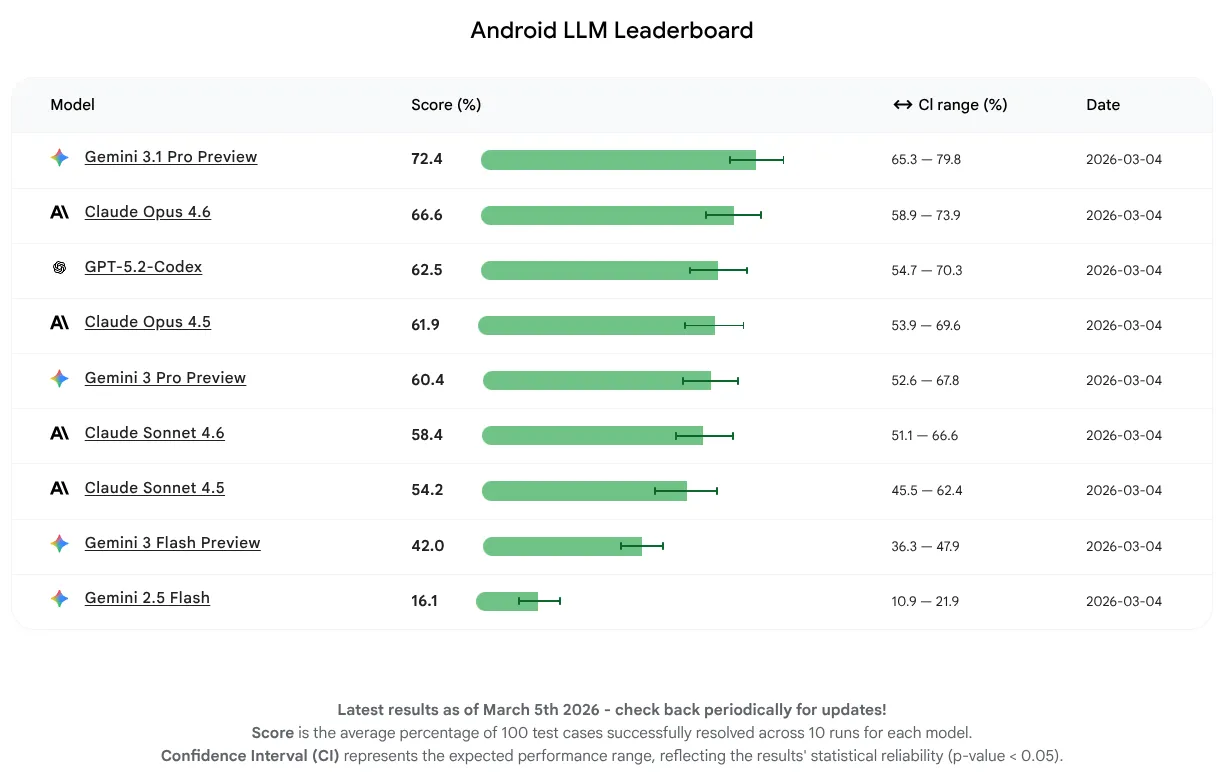

התוצאות הראשונות של Android Bench

בגרסה הראשונית הזו, רצינו למדוד את ביצועי המודל בלבד ולא להתמקד בשימוש בסוכנים או בכלים. המודלים הצליחו להשלים 16-72% מהמשימות. זהו טווח רחב שמראה שלחלק מה-LLM כבר יש בסיס חזק של ידע ב-Android, בעוד שלאחרים יש מקום לשיפור. לא משנה מה מצב המודלים כרגע, אנחנו צופים שיפור מתמשך כי אנחנו מעודדים את יוצרי ה-LLM לשפר את המודלים שלהם לפיתוח לאנדרואיד.

ה-LLM עם הציון הממוצע הכי גבוה בגרסה הראשונה הזו הוא Gemini 3.1 Pro, ואחריו Claude Opus 4.6. אתם יכולים לנסות את כל המודלים שבדקנו כדי לקבל עזרה מ-AI בפרויקטים שלכם ב-Android באמצעות מפתחות API בגרסה היציבה האחרונה של Android Studio.

מתן שקיפות למפתחים וליוצרי מודלים של שפה גדולה (LLM)

אנחנו מאמינים בגישה פתוחה ושקופה, ולכן פרסמנו ב-GitHub את המתודולוגיה, מערך הנתונים ומערכת הבדיקה לשימוש הציבור.

אחד האתגרים בכל מדד השוואה ציבורי הוא הסיכון לזיהום נתונים, שבו יכול להיות שהמודלים ראו משימות הערכה במהלך תהליך האימון שלהם. נקטנו אמצעים כדי לוודא שהתוצאות שלנו משקפות חשיבה רציונלית אמיתית ולא שינון או ניחוש, כולל בדיקה ידנית יסודית של מסלולי הסוכן או שילוב של מחרוזת קנרית כדי למנוע אימון.

בעתיד, נמשיך לפתח את המתודולוגיה שלנו כדי לשמור על השלמות של מערך הנתונים, וגם נבצע שיפורים בגרסאות עתידיות של המדד – למשל, נגדיל את כמות המשימות ואת המורכבות שלהן.

אנחנו מצפים לראות איך Android Bench יכול לשפר את העזרה מ-AI בטווח הארוך. החזון שלנו הוא לגשר על הפער בין קונספט לקוד איכותי. אנחנו מניחים את היסודות לעתיד שבו תוכלו לבנות כל דבר שרק תדמיינו ב-Android.

להמשך הקריאה

-

חדשות על מוצרים

בכנס Google I/O 2026, נציג 17 הכרזות חשובות למפתחי Android, שיתמקדו בפרודוקטיביות מבוססת-סוכנים, ב-Compose First כסטנדרט ממשק המשתמש שלנו, ובפיתוח מדיה בעלת ביצועים גבוהים ופיתוח אדפטיבי למערכת האקולוגית המתרחבת.

Matthew McCullough • משך הקריאה: 8 דקות

-

חדשות על מוצרים

היום, במהלך The Android Show, הכרזנו על המעבר של Android ממערכת הפעלה למערכת חכמה, שיוצרת יותר הזדמנויות לאינטראקציה עם האפליקציות שלכם.

Matthew McCullough • משך הקריאה: 4 דקות

-

חדשות על מוצרים

היום אנחנו משפרים את הפיתוח ל-Android עם Gemma 4, המודל הפתוח המתקדם ביותר שלנו, שנועד לספק יכולות מורכבות של חשיבה רציונלית וקריאה אוטונומית לכלים.

Matthew McCullough • משך הקריאה: 2 דקות

כדאי תמיד להיות בעניינים

רוצים לקבל טיפים עדכניים לפיתוח Android ישירות לאימייל כל שבוע?