Novità sul prodotto

Migliorare lo sviluppo Android assistito dall'AI e perfezionare gli LLM con Android Bench

Lettura di 2 minuti

Vogliamo rendere più facile e veloce la creazione di app per Android di alta qualità e uno dei modi in cui ti aiutiamo a essere più produttivo è mettere l'AI a portata di mano. Sappiamo che vuoi un'AI che comprenda davvero le sfumature della piattaforma Android, motivo per cui abbiamo misurato le prestazioni dei LLM nelle attività di sviluppo per Android. Oggi abbiamo rilasciato la prima versione di Android Bench, la nostra classifica ufficiale dei LLM per lo sviluppo di Android.

Il nostro obiettivo è fornire ai creatori di modelli un benchmark per valutare le funzionalità LLM per lo sviluppo di Android. Stabilendo una base di riferimento chiara e affidabile per lo sviluppo di Android di alta qualità, aiutiamo i creatori di modelli a identificare le lacune e ad accelerare i miglioramenti, il che consente agli sviluppatori di lavorare in modo più efficiente con una gamma più ampia di modelli utili tra cui scegliere per l'assistenza AI, il che alla fine porterà ad app di qualità superiore in tutto l'ecosistema Android.

Progettato con attività di sviluppo Android reali

Abbiamo creato il benchmark selezionando un insieme di attività in una serie di aree di sviluppo Android comuni. È composto da sfide reali di varia difficoltà, provenienti da repository GitHub Android pubblici. Gli scenari includono la risoluzione di modifiche che causano interruzioni nelle release di Android, attività specifiche del dominio come la rete sui dispositivi indossabili e la migrazione all'ultima versione di Jetpack Compose, solo per citarne alcuni.

Ogni valutazione tenta di far risolvere al modello LLM il problema segnalato nell'attività, che poi verifichiamo utilizzando test delle unità o di strumentazione. Questo approccio indipendente dal modello ci consente di misurare la capacità di un modello di navigare in codebase complesse, comprendere le dipendenze e risolvere i problemi che incontri ogni giorno.

Abbiamo convalidato questa metodologia con diversi produttori di LLM, tra cui JetBrains.

"Misurare l'impatto dell'AI su Android è una sfida enorme, quindi è fantastico vedere un framework così solido e realistico. Sebbene siamo attivi nel benchmarking, Android Bench è un'aggiunta unica e gradita. Questa metodologia è esattamente il tipo di valutazione rigorosa di cui gli sviluppatori Android hanno bisogno in questo momento."

- Kirill Smelov, Head of AI Integrations di JetBrains.

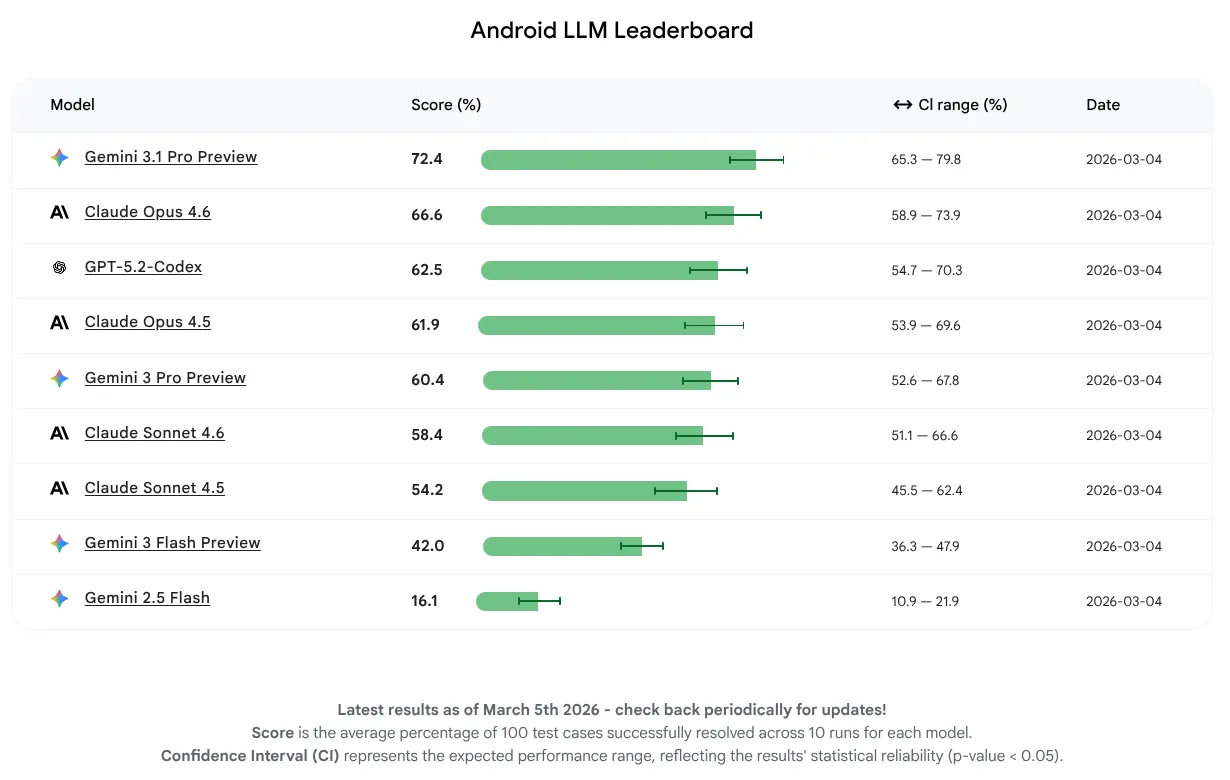

I primi risultati di Android Bench

Per questa release iniziale, volevamo misurare puramente le prestazioni del modello e non concentrarci sull'utilizzo di agenti o strumenti. I modelli sono riusciti a completare correttamente il 16-72% delle attività. Si tratta di un'ampia gamma che dimostra che alcuni LLM hanno già una solida base di conoscenza di Android, mentre altri hanno più margini di miglioramento. Indipendentemente dallo stato attuale dei modelli, prevediamo un miglioramento continuo, in quanto incoraggiamo i creatori di LLM a migliorare i propri modelli per lo sviluppo di Android.

Il modello LLM con il punteggio medio più alto per questa prima release è Gemini 3.1 Pro, seguito da vicino da Claude Opus 4.6. Puoi provare tutti i modelli che abbiamo valutato per l'assistenza AI per i tuoi progetti Android utilizzando le chiavi API nell'ultima versione stabile di Android Studio.

Fornire trasparenza a sviluppatori e creatori di LLM

Apprezziamo un approccio aperto e trasparente, pertanto abbiamo reso pubblicamente disponibili su GitHub la nostra metodologia, il set di dati e il banco di prova.

Una sfida per qualsiasi benchmark pubblico è il rischio di contaminazione dei dati, in cui i modelli potrebbero aver visto attività di valutazione durante il processo di addestramento. Abbiamo adottato misure per garantire che i nostri risultati riflettano un ragionamento autentico piuttosto che la memorizzazione o la supposizione, tra cui una revisione manuale approfondita delle traiettorie degli agenti o l'integrazione di una stringa canary per scoraggiare l'addestramento.

In futuro, continueremo a far evolvere la nostra metodologia per preservare l'integrità del set di dati, apportando al contempo miglioramenti per le versioni future del benchmark, ad esempio aumentando la quantità e la complessità delle attività.

Siamo ansiosi di scoprire come Android Bench può migliorare l'assistenza AI a lungo termine. La nostra vision è colmare il divario tra il concetto e il codice di qualità. Stiamo gettando le basi per un futuro in cui, a prescindere da ciò che immagini, potrai realizzarlo su Android.

Continua a leggere

-

Novità sul prodotto

Oggi stiamo migliorando lo sviluppo per Android con Gemma 4, il nostro modello aperto all'avanguardia più recente progettato con funzionalità di ragionamento complesso e chiamata di strumenti autonomi.

Matthew McCullough • Lettura di 2 minuti

-

Novità sul prodotto

Android 17 ha raggiunto ufficialmente la stabilità della piattaforma oggi con la beta 3. Ciò significa che la superficie API è bloccata. Puoi eseguire i test di compatibilità finali e caricare le app che hanno come target Android 17 sul Play Store.

Matthew McCullough • Lettura di 5 minuti

-

Novità sul prodotto

Oggi rilasceremo la seconda beta di Android 17, continuando il nostro lavoro per creare una piattaforma che dia la priorità a privacy, sicurezza e prestazioni ottimizzate.

Matthew McCullough • Lettura di 6 minuti

Segui gli aggiornamenti

Ricevi ogni settimana gli ultimi approfondimenti sullo sviluppo per Android direttamente nella tua casella di posta.