Nowości dotyczące produktów

Jak automatyczna optymalizacja podpowiedzi zwiększa jakość interfejsu ML Kit GenAI Prompt API

3 minuty czytania

Automatyczna optymalizacja podpowiedzi (APO)

Aby jeszcze bardziej ułatwić wdrażanie w środowisku produkcyjnym przypadków użycia interfejsu ML Kit Prompt API, z przyjemnością ogłaszamy automatyczną optymalizację podpowiedzi (APO) kierowaną na modele na urządzeniu w Vertex AI. Automatyczna optymalizacja podpowiedzi to narzędzie, które pomaga automatycznie znajdować optymalne podpowiedzi w Twoich przypadkach użycia.

Era AI na urządzeniu nie jest już obietnicą – to rzeczywistość produkcyjna. Wraz z wprowadzeniem Gemini Nano v3 udostępniamy użytkownikom bezprecedensowe możliwości rozumienia języka i multimodalne. Dzięki rodzinie modeli Gemini Nano mamy szeroki zakres obsługiwanych urządzeń w ekosystemie Androida. Jednak dla deweloperów tworzących aplikacje inteligentne nowej generacji dostęp do zaawansowanego modelu to dopiero pierwszy krok. Prawdziwym wyzwaniem jest dostosowanie: jak dostosować model podstawowy do wydajności na poziomie eksperta w konkretnym przypadku użycia bez naruszania ograniczeń sprzętu mobilnego?

W przypadku po stronie serwera większe modele LLM są zwykle bardzo wydajne i wymagają mniejszego dostosowania do domeny. W razie potrzeby można też stosować bardziej zaawansowane opcje, takie jak dostrajanie LoRA (adaptacja o niskim rzędzie). Jednak unikalna architektura Androida AICore traktuje priorytetowo wspólny, wydajny pod względem pamięci model systemu. Oznacza to, że wdrażanie niestandardowych adapterów LoRA w każdej aplikacji wiąże się z wyzwaniami w przypadku tych wspólnych usług systemowych.

Istnieje jednak alternatywna ścieżka, która może być równie skuteczna. Dzięki wykorzystaniu automatycznej optymalizacji podpowiedzi (APO) w Vertex AI deweloperzy mogą osiągnąć jakość zbliżoną do dostrajania, a jednocześnie płynnie pracować w natywnym środowisku wykonawczym Androida. Dzięki skupieniu się na lepszych instrukcjach systemowych APO umożliwia deweloperom dostosowywanie zachowania modelu z większą niezawodnością i skalowalnością niż tradycyjne rozwiązania do dostrajania.

Uwaga: Gemini Nano V3 to zoptymalizowana pod kątem jakości wersja wysoko ocenianego modelu Gemma 3N. Wszystkie optymalizacje podpowiedzi wprowadzone w modelu Gemma 3N o otwartym kodzie źródłowym będą też stosowane w Gemini Nano V3. Na obsługiwanych urządzeniach interfejsy ML Kit GenAI API wykorzystują model nano-v3, aby zmaksymalizować jakość dla deweloperów Androida.

APO traktuje podpowiedź nie jako statyczny tekst, ale jako programowalną powierzchnię, którą można zoptymalizować. Wykorzystuje modele po stronie serwera (takie jak Gemini Pro i Flash) do proponowania podpowiedzi, oceniania wariantów i znajdowania optymalnego rozwiązania dla konkretnego zadania. Ten proces wykorzystuje 3 konkretne mechanizmy techniczne, aby zmaksymalizować wydajność:

- Automatyczna analiza błędów: APO analizuje wzorce błędów z danych treningowych, aby automatycznie identyfikować konkretne słabe punkty w początkowej podpowiedzi.

- Destylacja instrukcji semantycznych: analizuje ogromne przykłady treningowe, aby wydestylować „prawdziwy cel” zadania, tworząc instrukcje, które dokładniej odzwierciedlają rzeczywisty rozkład danych.

- Równoległe testowanie kandydatów: zamiast testować po jednym pomyśle, APO generuje i testuje równolegle wiele kandydatów na podpowiedzi, aby zidentyfikować globalne maksimum jakości.

Dlaczego APO może zbliżyć się do jakości dostrajania

Powszechnie uważa się, że dostrajanie zawsze daje lepszą jakość niż podpowiedzi. W przypadku nowoczesnych modeli podstawowych, takich jak Gemini Nano v3, inżynieria podpowiedzi może być sama w sobie skuteczna:

- Zachowanie ogólnych możliwości: dostrajanie ( PEFT/LoRA) wymusza na modelu nadmierne indeksowanie wagi w określonym rozkładzie danych. Często prowadzi to do „katastrofalnego zapominania”, w którym model lepiej radzi sobie z konkretną składnią, ale gorzej z ogólną logiką i bezpieczeństwem. APO nie zmienia wagi, zachowując możliwości modelu podstawowego.

- Wykonywanie instrukcji i odkrywanie strategii: Gemini Nano v3 został dokładnie wytrenowany pod kątem wykonywania złożonych instrukcji systemowych. APO wykorzystuje to, znajdując dokładną strukturę instrukcji, która odblokowuje ukryte możliwości modelu, często odkrywając strategie, które mogą być trudne do znalezienia dla inżynierów.

Aby zweryfikować to podejście, przeprowadziliśmy ocenę APO w różnych zbiorach zadań produkcyjnych. Nasza weryfikacja wykazała stały wzrost dokładności o 5–8% w różnych przypadkach użycia.W przypadku wielu wdrożonych funkcji na urządzeniu APO zapewniło znaczną poprawę jakości.

| Przypadek użycia | Typ zadania | Opis zadania | Wskaźnik | Ulepszenie APO |

| Klasyfikacja tematu | Klasyfikacja tekstu | Klasyfikowanie artykułu informacyjnego według tematów, takich jak finanse, sport itp. | Dokładność | +5% |

| Klasyfikacja intencji | Klasyfikacja tekstu | Klasyfikowanie zapytania do obsługi klienta według intencji | Dokładność | +8,0% |

| Tłumaczenie strony internetowej | Tłumaczenie tekstu | Tłumaczenie strony internetowej z angielskiego na język lokalny | BLEU | +8,57% |

Płynny przepływ pracy dewelopera

Powszechnie uważa się, że dostrajanie zawsze daje lepszą jakość niż podpowiedzi. W przypadku nowoczesnych modeli podstawowych, takich jak Gemini Nano v3, inżynieria podpowiedzi może być sama w sobie skuteczna:

- Zachowanie ogólnych możliwości: dostrajanie ( PEFT/LoRA) wymusza na modelu nadmierne indeksowanie wagi w określonym rozkładzie danych. Często prowadzi to do „katastrofalnego zapominania”, w którym model lepiej radzi sobie z konkretną składnią, ale gorzej z ogólną logiką i bezpieczeństwem. APO nie zmienia wagi, zachowując możliwości modelu podstawowego.

- Wykonywanie instrukcji i odkrywanie strategii: Gemini Nano v3 został dokładnie wytrenowany pod kątem wykonywania złożonych instrukcji systemowych. APO wykorzystuje to, znajdując dokładną strukturę instrukcji, która odblokowuje ukryte możliwości modelu, często odkrywając strategie, które mogą być trudne do znalezienia dla inżynierów.

Aby zweryfikować to podejście, przeprowadziliśmy ocenę APO w różnych zbiorach zadań produkcyjnych. Nasza weryfikacja wykazała stały wzrost dokładności o 5–8% w różnych przypadkach użycia.W przypadku wielu wdrożonych funkcji na urządzeniu APO zapewniło znaczną poprawę jakości.

Podsumowanie

Wprowadzenie automatycznej optymalizacji podpowiedzi (APO) to punkt zwrotny w rozwoju generatywnej AI na urządzeniu. Dzięki zmniejszeniu różnicy między modelami podstawowymi a wydajnością na poziomie eksperta dajemy deweloperom narzędzia do tworzenia bardziej niezawodnych aplikacji mobilnych. Niezależnie od tego, czy dopiero zaczynasz korzystać z optymalizacji bez przykładów , czy skalujesz się do produkcji za pomocą dostrajania opartego na danych , ścieżka do wysokiej jakości inteligencji na urządzeniu jest teraz jaśniejsza. Już dziś możesz wdrożyć w środowisku produkcyjnym przypadki użycia na urządzeniu za pomocą interfejsu ML Kit Prompt API i automatycznej optymalizacji podpowiedzi w Vertex AI.

Przydatne linki:

Czytaj dalej

-

r.r.

Nowości dotyczące produktów

W Google dokładamy wszelkich starań, aby udostępniać najbardziej zaawansowane modele AI bezpośrednio na urządzeniach z Androidem. Z przyjemnością ogłaszamy dziś wprowadzenie naszego najnowszego, najnowocześniejszego modelu o otwartym kodzie źródłowym: Gemma 4.

Caren Chang, David Chou • 3 minuty czytania

-

Nowości dotyczące produktów

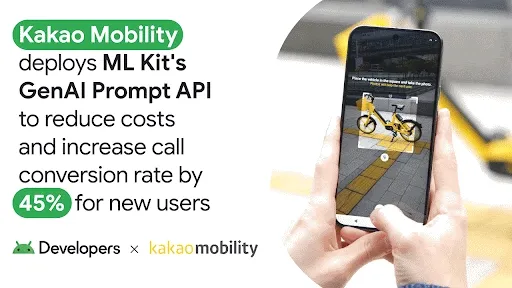

AI ułatwia tworzenie spersonalizowanych funkcji aplikacji, które przekształcają treści w odpowiedni format dla użytkowników. Wcześniej umożliwiliśmy deweloperom integrację z Gemini Nano za pomocą interfejsów ML Kit GenAI API dostosowanych do konkretnych przypadków użycia, takich jak podsumowywanie i opisywanie obrazów.

Caren Chang, Chengji Yan, Penny Li • 2 minuty czytania

-

Nowości dotyczące produktów

Ogłoszono dziś podczas The Android Show, że Android przechodzi z systemu operacyjnego do systemu inteligencji, co stwarza więcej możliwości interakcji z Twoimi aplikacjami.

Matthew McCullough • 4 minuty czytania

Bądź na bieżąco

Otrzymuj co tydzień najnowsze informacje o tworzeniu aplikacji na Androida na swoją skrzynkę odbiorczą.