デバイス上の AI に対するユーザーの期待は、アプリの利用方法を根本的に変えています。アプリを開いてタスクをステップごとに実行するのではなく、AI に重労働を任せるようになっています。この新しいインタラクション モデルでは、ユーザーにアプリを開いてもらうことではなく、ユーザーのタスクを確実に完了し、より多くの作業を迅速にこなせるようにすることが成功の鍵となります。

このエージェント主導の未来に向けてアプリを進化させるために、アプリとエージェント主導のアプリやパーソナライズされたアシスタント(Google Gemini など)とのギャップを埋める初期段階のデベロッパー向け機能が導入されます。この取り組みはまだベータ版の初期段階ですが、アプリ エコシステムにおけるこのパラダイム シフトを調査する最初のステップとして、プライバシーとセキュリティを中核に据えてこれらの機能を設計しています。

AppFunctions でアプリを強化する

Android の __AppFunctions を使用すると、アプリはデータと機能を AI エージェントとアシスタントに直接公開できます。デベロッパーは、 AppFunctions Jetpack ライブラリと プラットフォーム APIを使用して、エージェント主導のアプリが自然言語で検出して実行できる自己記述型関数を作成できます。AppFunctions は、バックエンド機能が MCP クラウド サーバーを介して宣言される方法を反映し、Android アプリのオンデバイス ソリューションを提供します。WebMCPと同様に、これらの関数はサーバーではなくデバイス上でローカルに実行されます。

Galaxy S26 シリーズの Gemini との Samsung ギャラリーの統合 は、AppFunctions の動作を示しています。フォトアルバムを手動でスクロールする代わりに、Gemini に「Samsung ギャラリーから猫の写真を見せて」と相談するだけで済みます。Gemini はユーザーのクエリを受け取り、適切な関数をインテリジェントに識別してトリガーし、Samsung ギャラリーから返された写真を Gemini アプリに直接表示するため、ユーザーはアプリを離れる必要がありません。このエクスペリエンスはマルチモーダルであり、音声またはテキストで行うことができます。ユーザーは、返された写真をフォローアップ会話で使用することもできます(テキスト メッセージで友人に送信するなど)。

この統合は現在、Galaxy S26 シリーズで利用可能であり、まもなく OneUI 8.5 以降を搭載した Samsung デバイスに拡大される予定です。AppFunctions を使用すると、Gemini はすでに複数のメーカーのデバイスで、カレンダー、メモ、タスクなどのアプリ カテゴリ全体でタスクを自動化できます。カレンダーの予定の調整、メモの整理、To-Do リマインダーの設定など、ユーザーは日常の作業を 1 か所で効率化できます。

インテリジェントな UI 自動化でエージェント主導のアプリを有効にする

AppFunctions は、アプリが AI エージェントやアシスタントと通信するための構造化されたフレームワークとより多くの制御を提供しますが、すべてのインタラクションに専用の統合がまだ存在しないことは承知しています。また、AI エージェントとアシスタントがユーザーのインストール済みのアプリで一般的なタスクをインテリジェントに実行するための UI 自動化フレームワークも開発しています。このフレームワークには、ユーザーに対する透明性と制御が組み込まれています。これはプラットフォームが重労働を行うため、デベロッパーはコードを記述せずにエージェント主導のリーチを実現できます。現在、大規模なエンジニアリング作業を行わずにリーチを拡大できる、手間のかからない方法です。

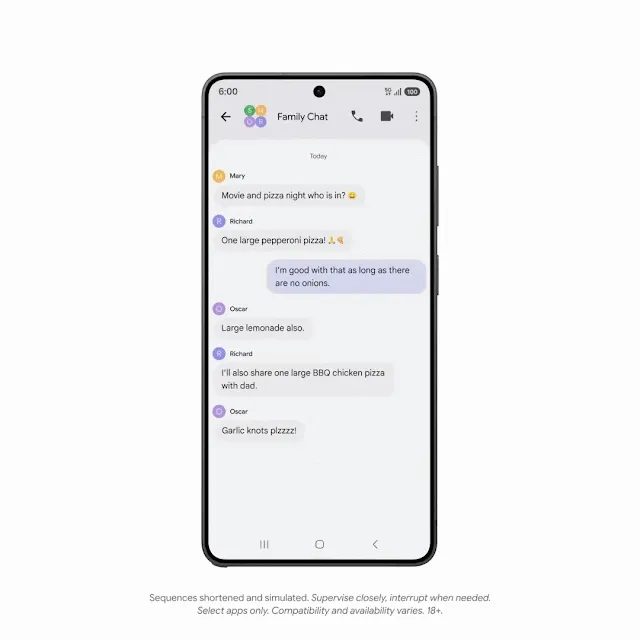

このフレームワークを改良するにあたりフィードバックを得るため、Galaxy S26 シリーズと一部の Google Pixel 10 デバイスで早期プレビューを開始します。ユーザーは、電源ボタンを長押しするだけで、複数ステップのタスクを Gemini に委任できます。Gemini アプリのベータ版機能としてリリースされ、米国と韓国の食品配達、食料品、ライドシェア カテゴリの厳選されたアプリをサポートします。ユーザーが、好みがうるさい家族のために複雑なピザの注文を行う必要がある場合でも、同僚との複数ストップのライドシェアを調整する場合でも、最後の食料品の購入を再注文する場合でも、Gemini はデベロッパーの作業を必要とせずに、アプリからすでに利用可能なコンテキストを使用してタスクを完了できます。

UI 自動化を通じてバックグラウンドでタスクが実行されている間、ユーザーは制御できます。自動化アクションの場合、ユーザーは通知または「ライブビュー」でタスクの進捗状況をモニタリングできます。また、いつでも手動制御に切り替えて操作を引き継ぐことができます。Gemini は、購入などの機密性の高いタスクを完了する前にユーザーにアラートを表示するように設計されています。

今後の展望

Android 17 では、これらの機能をさらに多くのユーザー、デベロッパー、デバイス メーカーに提供できるよう、拡大を目指しています。

現在、少数のアプリ デベロッパーと連携してエクスペリエンスを構築しており、エコシステムの進化に合わせて高品質のユーザー エクスペリエンスに重点を置いています。AppFunctions と UI 自動化を使用してアプリのエージェント主導の統合を有効にする方法については、年内に詳細をお知らせする予定です。最新情報にご期待ください。

続きを読む

-

プロダクト ニュース

本日 The Android Show で発表されたように、Android はオペレーティング システムからインテリジェンス システムに移行し、アプリとのエンゲージメントを深める機会を増やしています。

Matthew McCullough • 所要時間 4 分

-

プロダクト ニュース

本日、複雑な推論と自律的なツール呼び出し機能を備えた最新の最先端オープンモデルである Gemma 4 を使用して、Android 開発を強化します。

Matthew McCullough • 所要時間 2 分

-

プロダクト ニュース

Android 17 は本日、ベータ版 3 でプラットフォームの安定版に正式に到達しました。つまり、API サーフェスがロックされています。最終的な互換性テストを実施し、Android 17 をターゲットとするアプリを Google Play ストアに公開できます。

Matthew McCullough • 所要時間 5 分

最新情報の入手

Android 開発に関する最新の分析情報を毎週メールでお届けします。