Notizie sui prodotti

Crea per gli occhiali AI con l'anteprima per gli sviluppatori 3 dell'SDK di Android XR e sblocca nuove funzionalità per esperienze immersive

4 minuti di lettura

A ottobre, Samsung ha lanciato Galaxy XR, il primo dispositivo basato su Android XR. È stato fantastico vedere cosa hanno creato alcuni di voi. Ecco cosa hanno detto alcuni dei nostri sviluppatori sul loro percorso in Android XR.

Android XR ci ha dato un mondo completamente nuovo in cui creare la nostra app. I team dovrebbero chiedersi: qual è la versione più grande e audace della tua esperienza che potresti creare? Questa è la tua opportunità di mettere finalmente in pratica ciò che hai sempre voluto fare, perché ora hai la piattaforma che può renderlo reale. - Kristen Coke, Calm, Lead Product Manager

Abbiamo anche condiviso un'anteprima di altri dispositivi in arrivo che funzionano con Android XR, come Project Aura di XREAL e occhiali alla moda di Gentle Monster e Warby Parker.

Per supportare la selezione in espansione di dispositivi XR, annunciamo l'anteprima per gli sviluppatori 3 dell'SDK di Android XR.

Con l'anteprima per gli sviluppatori 3 dell'SDK di Android XR, oltre a creare esperienze immersive per dispositivi come Galaxy XR, ora puoi anche creare esperienze aumentate per i prossimi occhiali AI con Android XR.

Nuovi strumenti e librerie per esperienze aumentate

Con l'anteprima per gli sviluppatori 3, stiamo sbloccando gli strumenti e le librerie di cui hai bisogno per creare esperienze aumentate intelligenti e a mani libere per gli occhiali AI. Gli occhiali AI sono leggeri e portatili e possono essere indossati tutto il giorno. Puoi estendere la tua app mobile esistente per sfruttare gli altoparlanti, la fotocamera e il microfono integrati per fornire nuove interazioni utente ponderate e utili. Con l'aggiunta di un piccolo display sugli occhiali AI, puoi presentare informazioni agli utenti in privato. Gli occhiali AI sono perfetti per le esperienze che possono contribuire a migliorare la concentrazione e la presenza di un utente nel mondo reale.

Per potenziare le esperienze aumentate sugli occhiali AI, stiamo introducendo due nuove librerie appositamente create per l'SDK Jetpack XR:

- Jetpack Projected : progettata per collegare dispositivi mobili e occhiali AI con funzionalità che consentono di accedere a sensori, altoparlanti e display sugli occhiali

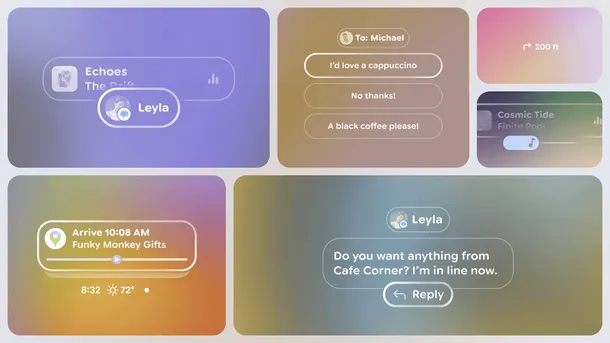

- Jetpack Compose Glimmer: nuovo linguaggio di progettazione e componenti UI per creare e personalizzare le esperienze aumentate sugli occhiali AI con display

Jetpack Compose Glimmer è una dimostrazione delle best practice di progettazione per esperienze aumentate ottiche trasparenti e di alta qualità. Con i componenti UI ottimizzati per la modalità di input e i requisiti di stile degli occhiali AI con display, Jetpack Compose Glimmer è progettato per la chiarezza, la leggibilità e la minima distrazione.

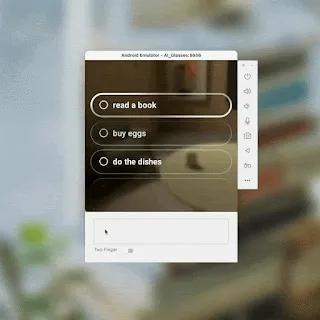

Per aiutarti a visualizzare e testare l'UI di Jetpack Compose Glimmer, stiamo introducendo l'emulatore di occhiali AI in Android Studio. Il nuovo emulatore di occhiali AI può simulare interazioni specifiche degli occhiali, come l'input vocale e tramite touchpad.

Oltre alle nuove librerie Jetpack Projected e Jetpack Compose Glimmer, stiamo anche espandendo ARCore per Jetpack XR per supportare gli occhiali AI. Iniziamo con il rilevamento del movimento e le funzionalità geospaziali per le esperienze aumentate, ovvero le funzionalità esatte che ti consentono di creare esperienze di navigazione utili perfette per i dispositivi da indossare tutto il giorno come gli occhiali AI.

Espansione del supporto per le esperienze immersive

Continuiamo a investire nelle librerie e negli strumenti che potenziano le esperienze immersive per i visori XR come Samsung Galaxy XR e gli occhiali XR connessi come il prossimo Project Aura di XREAL. Abbiamo ascoltato il tuo feedback e abbiamo aggiunto diverse funzionalità molto richieste all'SDK Jetpack XR dall'anteprima per gli sviluppatori 2.

Jetpack SceneCore ora include il caricamento dinamico dei modelli glTF tramite URI e il supporto migliorato dei materiali per la creazione di nuovi materiali PBR in fase di runtime. Inoltre, il componente SurfaceEntity è stato migliorato con il supporto completo di Widevine Digital Rights Management (DRM) e nuove forme, consentendo di eseguire il rendering di video a 360 e 180 gradi in sfere ed emisferi.

In Jetpack Compose for XR troverai nuove funzionalità come il componente UserSubspace per il comportamento di follow, che garantisce che i contenuti rimangano nella visualizzazione dell'utente indipendentemente da dove guarda. Inoltre, ora puoi utilizzare le animazioni spaziali per transizioni fluide come lo scorrimento o la dissolvenza. Per supportare un ecosistema in espansione di dispositivi immersivi con diverse funzionalità di visualizzazione, ora puoi specificare le dimensioni del layout come frazioni del campo visivo confortevole dell'utente.

In Material Design for XR, i nuovi componenti si adattano automaticamente a livello spaziale tramite override. Questi includono finestre di dialogo che si elevano a livello spaziale e barre di navigazione, che vengono visualizzate in un Orbiter. Inoltre, è disponibile un nuovo componente SpaceToggleButton per passare facilmente allo spazio completo e viceversa.

In ARCore per Jetpack XR sono state aggiunte nuove funzionalità di percezione, tra cui il tracciamento facciale con 68 valori di blendshape che sbloccano un mondo di gesti facciali. Puoi anche utilizzare l'eye tracking per potenziare gli avatar virtuali e le mappe di profondità per consentire interazioni più realistiche con l'ambiente di un utente.

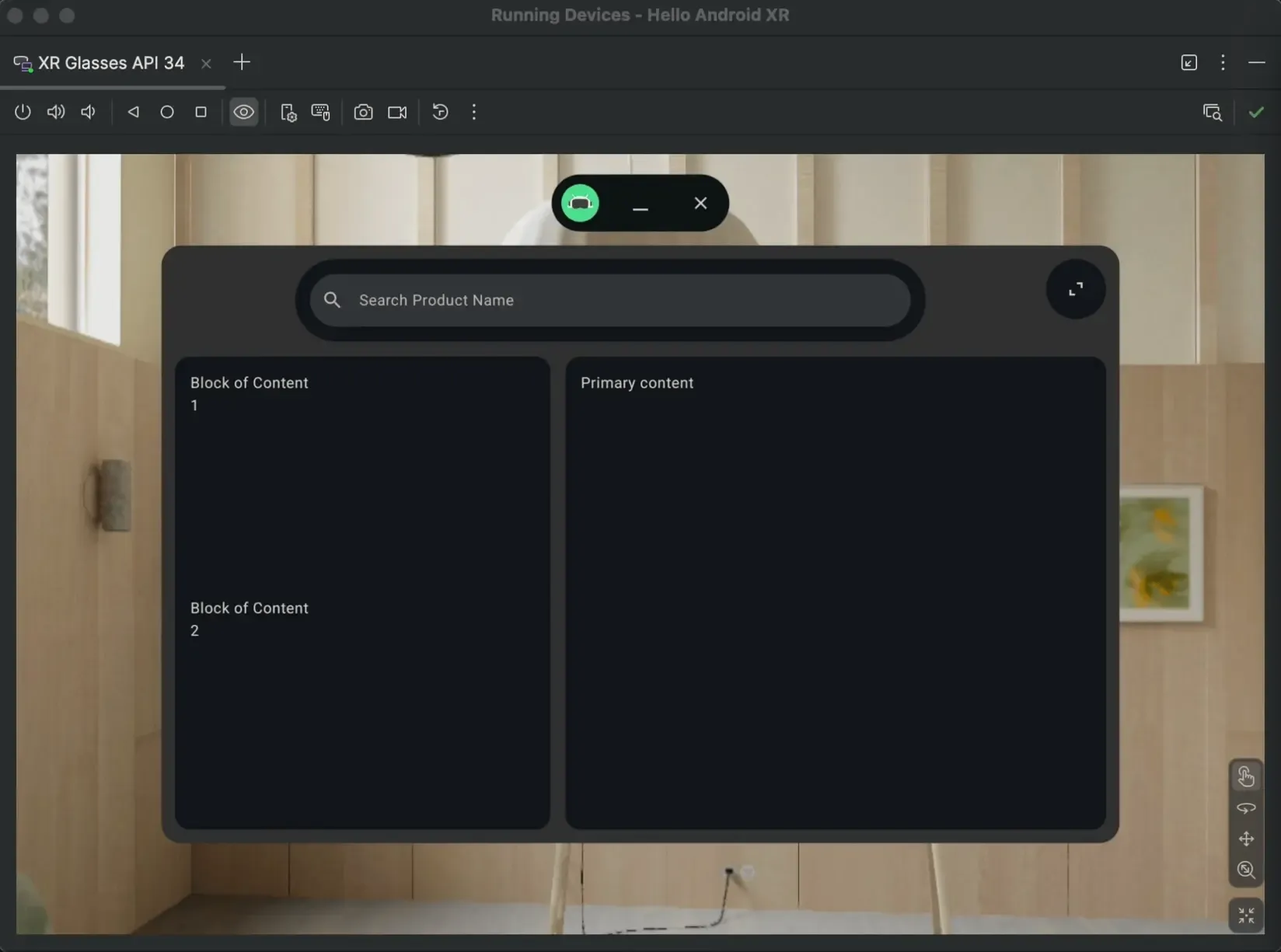

Per dispositivi come Project Aura di XREAL, stiamo introducendo l'emulatore di occhiali XR in Android Studio. Questo strumento essenziale è progettato per offrirti una visualizzazione accurata dei contenuti, abbinando le specifiche del dispositivo reale per il campo visivo (FoV), la risoluzione e il DPI per accelerare lo sviluppo.

Se crei esperienze immersive con Unity, stiamo anche espandendo le funzionalità di percezione nell'SDK di Android XR per Unity. Oltre a molte correzioni di bug e altri miglioramenti, stiamo espandendo le funzionalità di rilevamento per includere: codici QR e ArUco, immagini planari e rilevamento del corpo (sperimentale). Stiamo anche introducendo una funzionalità molto richiesta: la mesh della scena. Ti consente di avere interazioni molto più profonde con l'ambiente dell'utente: i tuoi contenuti digitali ora possono rimbalzare sulle pareti e salire sui divani.

E questa è solo la punta dell'iceberg. Per ulteriori informazioni, consulta la nostra pagina sulle esperienze immersive.

Inizia oggi stesso!

L'anteprima per gli sviluppatori 3 dell'SDK di Android XR è disponibile oggi. Scarica l'ultima versione Canary di Android Studio (Otter 3, Canary 4 o versioni successive) ed esegui l'upgrade all'ultima versione dell'emulatore (36.4.3 Canary o versioni successive), quindi visita la pagina developer.android.com/xr per iniziare a utilizzare le librerie e gli esempi più recenti di cui hai bisogno per creare per la selezione in espansione di dispositivi Android XR. Stiamo creando Android XR insieme a te. Non dimenticare di condividere il tuo feedback, i tuoi suggerimenti e le tue idee con il nostro team man mano che avanzi nel tuo percorso in Android XR.

Continua a leggere

-

Notizie sui prodotti

Oggi stiamo migliorando lo sviluppo Android con Gemma 4, il nostro modello aperto all'avanguardia più recente progettato con funzionalità di ragionamento complesso e di chiamata di strumenti autonomi.

Matthew McCullough • 2 minuti di lettura

-

Notizie sui prodotti

Oggi Android 17 ha raggiunto ufficialmente la stabilità della piattaforma con la beta 3. Ciò significa che la superficie API è bloccata; puoi eseguire i test di compatibilità finali e inviare le app destinate ad Android 17 al Play Store.

Matthew McCullough • 5 minuti di lettura

-

Notizie sui prodotti

Vogliamo rendere più facile e veloce la creazione di app per Android di alta qualità e un modo per aiutarti a essere più produttivo è mettere l'AI a portata di mano.

Matthew McCullough • 2 minuti di lettura

Segui gli aggiornamenti

Ricevi ogni settimana nella tua casella di posta le ultime informazioni sullo sviluppo Android