Notizie sui prodotti

Il sistema operativo intelligente: rendere gli agenti AI più utili per le app Android

3 minuti di lettura

Le aspettative degli utenti in merito all'AI sui loro dispositivi stanno cambiando radicalmente il modo in cui interagiscono con le app. Invece di aprire le app per eseguire le attività passo dopo passo, chiedono all'AI di fare il lavoro pesante per loro. In questo nuovo modello di interazione, il successo non dipende più dal fatto che gli utenti aprano la tua app, ma dalla capacità di completare le loro attività e aiutarli a fare di più in modo più rapido.

Per aiutarti a far evolvere le tue app in vista di questo futuro basato sugli agenti, stiamo introducendo funzionalità per sviluppatori in fase iniziale che colmano il divario tra le tue app e le app basate sugli agenti e gli assistenti personalizzati, come Google Gemini. Sebbene siamo nelle fasi iniziali della beta di questo percorso, stiamo progettando queste funzionalità con la privacy e la sicurezza come elementi fondamentali, come primo passo per esplorare questo cambio di paradigma come ecosistema di app.

Potenziare le app con AppFunctions

Android AppFunctions consente alle app di esporre dati e funzionalità direttamente agli agenti e agli assistenti AI. Con la libreria Jetpack AppFunctions e le API della piattaforma, gli sviluppatori possono creare funzioni autodescrittive che le app basate sugli agenti possono scoprire ed eseguire tramite il linguaggio naturale. Analogamente a come le funzionalità di backend vengono dichiarate tramite i server cloud MCP, AppFunctions fornisce una soluzione on-device per le app Android. Come WebMCP, esegue queste funzioni localmente sul dispositivo anziché su un server.

L'integrazione di Galleria di Samsung con Gemini sulla serie Galaxy S26 mostra AppFunctions in azione. Invece di scorrere manualmente gli album di foto, ora puoi semplicemente chiedere a Gemini di "Mostrami le foto del mio gatto da Galleria di Samsung". Gemini prende la query dell'utente, identifica e attiva in modo intelligente la funzione corretta e presenta le foto restituite da Galleria di Samsung direttamente nell'app Gemini, in modo che gli utenti non debbano mai uscire. Questa esperienza è multimodale e può essere eseguita tramite voce o testo. Gli utenti possono persino utilizzare le foto restituite nelle conversazioni successive, ad esempio inviandole agli amici in un messaggio di testo.

Questa integrazione è attualmente disponibile sulla serie Galaxy S26 e presto verrà estesa ai dispositivi Samsung con OneUI 8.5 e versioni successive. Tramite AppFunctions, Gemini può già automatizzare le attività in categorie di app come Calendar, Note e Attività su dispositivi di più produttori. Che si tratti di coordinare gli eventi di Calendar, organizzare le note o impostare promemoria per le cose da fare, gli utenti possono semplificare le attività quotidiane in un unico posto.

Abilitare le app basate sugli agenti con l'automazione intelligente dell'interfaccia utente

Sebbene AppFunctions fornisca un framework strutturato e un maggiore controllo per le app per comunicare con gli agenti e gli assistenti AI, sappiamo che non tutte le interazioni hanno ancora un'integrazione dedicata. Stiamo anche sviluppando un framework di automazione dell'interfaccia utente per gli agenti e gli assistenti AI per eseguire in modo intelligente attività generiche sulle app installate dagli utenti, con trasparenza e controllo integrati. È la piattaforma a fare il lavoro pesante, in modo che gli sviluppatori possano raggiungere gli agenti senza scrivere codice. È un modo che non richiede troppi sforzi per estendere la copertura senza un grande lavoro di ingegneria al momento.

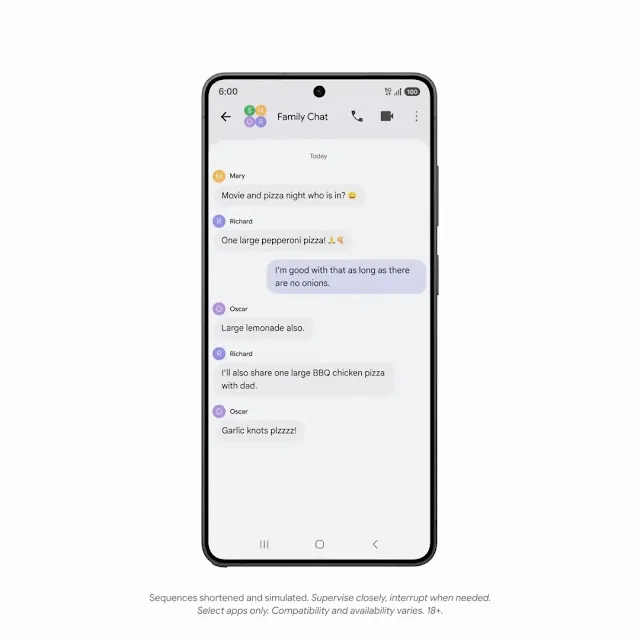

Per raccogliere feedback mentre perfezioniamo questo framework, stiamo iniziando con un'anteprima iniziale sulla serie Galaxy S26 e su alcuni dispositivi Pixel 10, dove gli utenti potranno delegare le attività in più passaggi a Gemini con una semplice pressione prolungata del tasto di accensione. Questa funzionalità verrà lanciata come beta nell'app Gemini e inizialmente supporterà una selezione curata di app nelle categorie di consegna di cibo, generi alimentari e ridesharing negli Stati Uniti e in Corea. Se gli utenti devono effettuare un ordine di pizza complesso per i membri della famiglia con gusti particolari, coordinare un ridesharing con più fermate con i colleghi o riordinare l'ultimo acquisto di generi alimentari, Gemini può aiutare a completare le attività utilizzando il contesto già disponibile dalle tue app, senza che gli sviluppatori debbano fare nulla.

Gli utenti hanno il controllo mentre un'attività viene eseguita in background tramite l'automazione dell'interfaccia utente. Per qualsiasi azione di automazione, gli utenti hanno la possibilità di monitorare l'avanzamento di un'attività tramite notifiche o "visualizzazione live" e possono passare al controllo manuale in qualsiasi momento per assumere il controllo dell'esperienza. Gemini è anche progettato per avvisare gli utenti prima di completare attività sensibili, come effettuare un acquisto.

Prospettive future

In Android 17, stiamo cercando di ampliare queste funzionalità per raggiungere un numero ancora maggiore di utenti, sviluppatori e produttori di dispositivi.

Al momento stiamo creando esperienze con un piccolo gruppo di sviluppatori di app, concentrandoci su esperienze utente di alta qualità man mano che l'ecosistema si evolve. Prevediamo di condividere ulteriori dettagli nel corso dell'anno su come utilizzare AppFunctions e l'automazione dell'interfaccia utente per abilitare le integrazioni basate sugli agenti per la tua app. Continua a seguirci per gli aggiornamenti.

Continua a leggere

-

Notizie sui prodotti

Oggi stiamo migliorando lo sviluppo Android con Gemma 4, il nostro modello aperto all'avanguardia più recente progettato con funzionalità di ragionamento complesso e chiamata di strumenti autonomi.

Matthew McCullough • 2 minuti di lettura

-

Notizie sui prodotti

Oggi Android 17 ha ufficialmente raggiunto la stabilità della piattaforma con la beta 3. Ciò significa che la superficie API è bloccata. Puoi eseguire i test di compatibilità finali e inviare le app destinate ad Android 17 al Play Store.

Matthew McCullough • 5 minuti di lettura

-

Notizie sui prodotti

Vogliamo rendere più facile e veloce la creazione di app per Android di alta qualità e uno dei modi in cui ti aiutiamo a essere più produttivo è mettere l'AI a portata di mano.

Matthew McCullough • 2 minuti di lettura

Segui gli aggiornamenti

Ricevi ogni settimana nella tua casella di posta le ultime informazioni sullo sviluppo Android