Actualités sur les produits

Créez des applications pour les lunettes IA avec la Preview développeur 3 du SDK Android XR et débloquez de nouvelles fonctionnalités pour des expériences immersives

4 minutes de lecture

En octobre, Samsung a lancé le Galaxy XR, le premier appareil équipé d'Android XR. Nous sommes ravis de voir ce que certains d'entre vous ont créé ! Voici quelques témoignages de nos développeurs sur leur expérience avec Android XR.

Android XR nous a ouvert un tout nouveau monde pour créer notre application. Les équipes doivent se demander : quelle est la version la plus ambitieuse et la plus audacieuse de votre expérience que vous pourriez créer ? C'est l'occasion de mettre enfin en œuvre ce que vous avez toujours voulu faire, car vous disposez désormais de la plate-forme qui peut le rendre possible. - Kristen Coke, Calm, responsable de la gestion des produits

Nous vous avons également donné un premier aperçu d'autres appareils à venir qui fonctionnent avec Android XR, comme le Project Aura de XREAL et les lunettes élégantes de Gentle Monster et Warby Parker.

Pour prendre en charge la sélection croissante d'appareils XR, nous annonçons la Preview développeur 3 du SDK Android XR.

Avec la Preview développeur 3 du SDK Android XR, en plus de créer des expériences immersives pour des appareils tels que le Galaxy XR, vous pouvez désormais créer des expériences augmentées pour les lunettes IA à venir avec Android XR.

Nouveaux outils et bibliothèques pour les expériences augmentées

Avec la Preview développeur 3, nous débloquons les outils et les bibliothèques dont vous avez besoin pour créer des expériences augmentées intelligentes et mains libres pour les lunettes IA. Les lunettes IA sont légères et portables pour être portées toute la journée. Vous pouvez étendre votre application mobile existante pour profiter des haut-parleurs, de l'appareil photo et du micro intégrés afin de proposer des interactions utilisateur nouvelles, réfléchies et utiles. En ajoutant un petit écran sur les lunettes IA, vous pouvez présenter des informations aux utilisateurs de manière privée. Les lunettes IA sont idéales pour les expériences qui peuvent aider à améliorer la concentration et la présence d'un utilisateur dans le monde réel.

Pour alimenter les expériences augmentées sur les lunettes IA, nous introduisons deux nouvelles bibliothèques spécialement conçues pour le SDK Jetpack XR :

- Jetpack Projected : conçu pour relier les appareils mobiles et les lunettes IA avec des fonctionnalités qui vous permettent d'accéder aux capteurs, aux haut-parleurs et aux écrans des lunettes

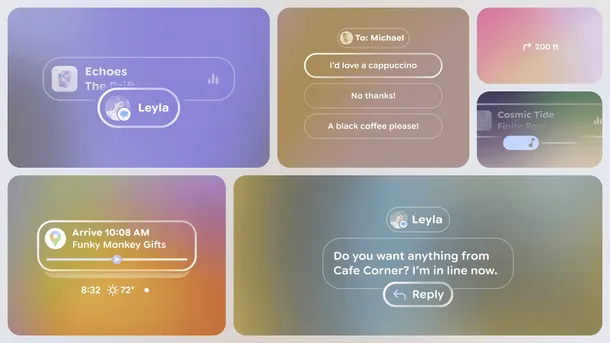

- Jetpack Compose Glimmer : nouveau langage de conception et composants d'interface utilisateur pour créer et styliser vos expériences augmentées sur les lunettes IA

Jetpack Compose Glimmer est une démonstration des bonnes pratiques de conception pour des expériences augmentées belles et optiquement transparentes. Avec des composants d'interface utilisateur optimisés pour la modalité d'entrée et les exigences de style des lunettes IA, Jetpack Compose Glimmer est conçu pour la clarté, la lisibilité et une distraction minimale.

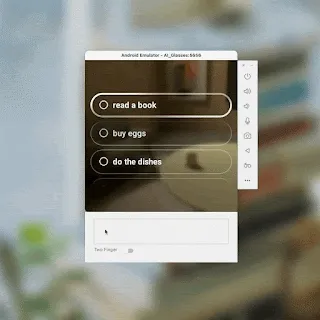

Pour vous aider à visualiser et à tester votre interface utilisateur Jetpack Compose Glimmer, nous introduisons l'émulateur de lunettes IA dans Android Studio. Le nouvel émulateur de lunettes IA peut simuler des interactions spécifiques aux lunettes, telles que l'entrée vocale et le pavé tactile.

Au-delà des nouvelles bibliothèques Jetpack Projected et Jetpack Compose Glimmer, nous étendons également ARCore pour Jetpack XR afin de prendre en charge les lunettes IA. Nous commençons par le suivi des mouvements et les fonctionnalités géospatiales pour les expériences augmentées, les fonctionnalités exactes qui vous permettent de créer des expériences de navigation utiles, parfaites pour les appareils portés toute la journée comme les lunettes IA.

Prise en charge étendue des expériences immersives

Nous continuons d'investir dans les bibliothèques et les outils qui alimentent les expériences immersives pour les casques XR comme le Samsung Galaxy XR et les lunettes XR filaires comme le futur Project Aura de XREAL. Nous avons tenu compte de vos commentaires et ajouté plusieurs fonctionnalités très demandées au SDK Jetpack XR depuis la Preview développeur 2.

Jetpack SceneCore propose désormais le chargement dynamique de modèles glTF via des URI et une prise en charge améliorée des matériaux pour créer de nouveaux matériaux PBR au moment de l'exécution. De plus, le composant SurfaceEntity a été amélioré avec une prise en charge complète de la gestion des droits numériques Widevine (DRM) et de nouvelles formes, ce qui lui permet de rendre des vidéos à 360 et 180 degrés dans des sphères et des hémisphères.

Dans Jetpack Compose pour XR, vous trouverez de nouvelles fonctionnalités telles que le composant UserSubspace pour le comportement de suivi, qui garantit que le contenu reste dans le champ de vision de l'utilisateur, où qu'il regarde. De plus, vous pouvez désormais utiliser des animations spatiales pour des transitions fluides, comme le glissement ou l'estompage. Et pour prendre en charge un écosystème en pleine expansion d'appareils immersifs avec des capacités d'affichage diverses, vous pouvez désormais spécifier les tailles de mise en page sous forme de fractions du champ de vision confortable de l'utilisateur.

Dans Material Design pour XR, les nouveaux composants s'adaptent automatiquement dans l'espace via des remplacements. Il s'agit, entre autres, de boîtes de dialogue qui s'affichent dans l'espace et de barres de navigation qui s'affichent dans un Orbiter. De plus, un nouveau composant SpaceToggleButton permet de passer facilement de l'espace complet à l'espace réduit et inversement.

Dans ARCore pour Jetpack XR, de nouvelles capacités de perception ont été ajoutées, y compris le suivi du visage avec 68 valeurs de blendshape, ce qui ouvre un monde de gestes faciaux. Vous pouvez également utiliser le suivi oculaire pour alimenter les avatars virtuels et les cartes de profondeur pour permettre des interactions plus réalistes avec l'environnement d'un utilisateur.

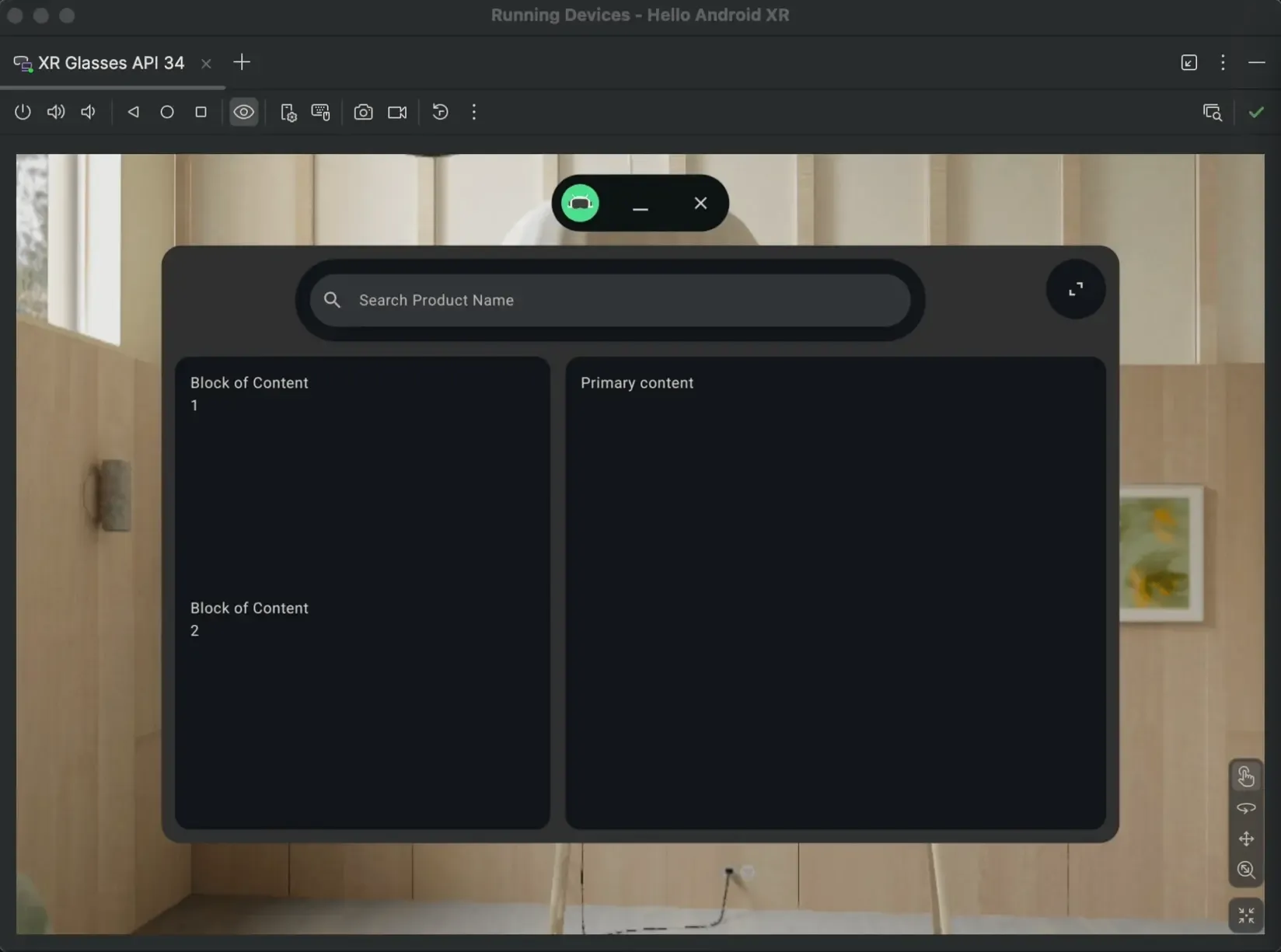

Pour les appareils comme le Project Aura de XREAL, nous introduisons l'émulateur de lunettes XR dans Android Studio. Cet outil essentiel est conçu pour vous offrir une visualisation précise du contenu, tout en correspondant aux spécifications réelles de l'appareil pour le champ de vision, la résolution et le DPI afin d'accélérer votre développement.

Si vous créez des expériences immersives avec Unity, nous étendons également vos capacités de perception dans le SDK Android XR pour Unity. En plus de nombreuses corrections de bugs et d'autres améliorations, nous étendons les capacités de suivi pour inclure les codes QR et ArUco, les images planes et le suivi du corps (expérimental). Nous introduisons également une fonctionnalité très demandée : le maillage de scène. Il vous permet d'interagir beaucoup plus en profondeur avec l'environnement de votre utilisateur : votre contenu numérique peut désormais rebondir sur les murs et grimper sur les canapés !

Et ce n'est que la partie émergée de l'iceberg ! Pour en savoir plus, consultez notre page sur les expériences immersives.

Lancez-vous !

La Preview développeur 3 du SDK Android XR est disponible dès aujourd'hui. Téléchargez la dernière version Canary d'Android Studio (Otter 3, Canary 4 ou version ultérieure) et passez à la dernière version de l'émulateur (36.4.3 Canary ou version ultérieure), puis accédez à developer.android.com/xr pour commencer à utiliser les dernières bibliothèques et les derniers exemples dont vous avez besoin pour créer des applications pour la sélection croissante d'appareils Android XR. Nous créons Android XR avec vous ! N'oubliez pas de partager vos commentaires, suggestions et idées avec notre équipe au fur et à mesure de votre parcours dans Android XR.

Lire la suite

-

Actualités sur les produits

Aujourd'hui, nous améliorons le développement Android avec Gemma 4, notre dernier modèle ouvert de pointe conçu avec des capacités de raisonnement complexes et d'appel d'outils autonomes.

Matthew McCullough • 2 minutes de lecture

-

Actualités sur les produits

Android 17 a officiellement atteint la stabilité de la plate-forme aujourd'hui avec la version bêta 3. Cela signifie que la surface de l'API est verrouillée. Vous pouvez effectuer les tests de compatibilité finaux et envoyer vos applications ciblant Android 17 sur le Play Store.

Matthew McCullough • 5 minutes de lecture

-

Actualités sur les produits

Nous voulons vous aider à créer plus rapidement et plus facilement des applications Android de haute qualité. Pour cela, nous mettons l'IA à votre disposition.

Matthew McCullough • 2 minutes de lecture

Restez informé

Recevez chaque semaine les dernières informations sur le développement Android directement dans votre boîte de réception.