自動プロンプト最適化(APO)

ML Kit Prompt API のユースケースを本番環境に導入しやすくするため、Vertex AI のオンデバイス モデルを対象とした自動プロンプト最適化(APO)を発表いたします。自動プロンプト最適化は、ユースケースに最適なプロンプトを自動的に見つけるのに役立つツールです。

オンデバイス AI の時代は、もはや約束ではなく、本番環境での現実となっています。Gemini Nano v3 のリリースにより、これまでにない言語理解とマルチモーダル機能をユーザーの手のひらに直接提供できるようになりました。Gemini Nano モデル ファミリーを通じて、Android エコシステム全体でサポートされているデバイスを幅広くカバーしています。しかし、次世代のインテリジェント アプリを構築するデベロッパーにとって、強力なモデルへのアクセスは最初のステップにすぎません。真の課題はカスタマイズです。モバイル ハードウェアの制約を破ることなく、特定のユースケースでエキスパート レベルのパフォーマンスを実現するように基盤モデルを調整するにはどうすればよいでしょうか。

サーバーサイドの世界では、大規模な LLM は高性能で、ドメイン適応の必要性が低い傾向があります。必要な場合でも、LoRA(Low-Rank Adaptation)ファインチューニングなどの高度なオプションが実現可能な選択肢となる可能性があります。ただし、Android AICore の独自のアーキテクチャでは、共有のメモリ効率の高いシステムモデル が優先されます。つまり、個々のアプリごとにカスタム LoRA アダプタをデプロイすると、これらの共有システム サービスで問題が発生します。

しかし、同様に影響力のある別の方法があります。Vertex AI で自動プロンプト最適化(APO) を活用することで、デベロッパーはネイティブの Android 実行環境内でシームレスに作業しながら、ファインチューニングに近い品質を実現できます。優れたシステム命令に重点を置くことで、APO を使用すると、従来のファインチューニング ソリューションよりも堅牢性と拡張性に優れた方法でモデルの動作を調整できます。

注: Gemini Nano V3 は、高い評価を得ている Gemma 3N モデルの品質最適化バージョンです。オープンソースの Gemma 3N モデルで行われたプロンプトの最適化は、Gemini Nano V3 にも適用されます。サポートされているデバイスでは、ML Kit GenAI API は nano-v3 モデルを活用して、Android デベロッパーの品質を最大限に高めます。

APO は、プロンプトを静的なテキストではなく、最適化可能なプログラマブルなサーフェスとして扱います。サーバーサイド モデル(Gemini Pro や Flash など)を活用してプロンプトを提案し、バリエーションを評価して、特定のタスクに最適なプロンプトを見つけます。このプロセスでは、パフォーマンスを最大化するために次の 3 つの特定の技術メカニズムが採用されています。

- 自動エラー分析: APO はトレーニング データのエラーパターンを分析して、初期プロンプトの特定の弱点を自動的に特定します。

- セマンティック命令の蒸留: 大量のトレーニング サンプルを分析してタスクの「真の意図」を抽出します。これにより、実際のデータ分布をより正確に反映した命令を作成できます。

- 並列候補テスト: APO は、一度に 1 つのアイデアをテストするのではなく、多数のプロンプト候補を並行して生成してテストし、品質のグローバル最大値を特定します。

APO がファインチューニングの品質に近づける理由

ファインチューニングは常にプロンプトよりも品質が向上するという誤解がよくあります。Gemini Nano v3 などの最新の基盤モデルでは、プロンプト エンジニアリング自体が影響を与える可能性があります。

- 一般的な機能の維持: ファインチューニング(PEFT/LoRA)では、モデルの重みが特定のデータ分布に過度にインデックス化されます。これにより、「壊滅的な忘却」が発生することがよくあります。つまり、モデルは特定の構文では優れていますが、一般的なロジックと安全性では劣ります。APO は重みを変更せず、基盤モデルの機能を維持します。

- 命令の追跡と戦略の発見: Gemini Nano v3 は、複雑なシステム命令に従うように厳密にトレーニングされています。APO は、モデルの潜在的な機能を解放する正確な命令構造を見つけることで、この機能を活用します。多くの場合、人間のエンジニアが見つけるのが難しい戦略を発見します。

このアプローチを検証するため、さまざまな本番環境ワークロードで APO を評価しました。検証の結果、さまざまなユースケースで精度が 5 ~ 8% 向上 していることがわかりました。デプロイされた複数のオンデバイス機能で、APO により品質が大幅に向上しました。

| ユースケース | タスクタイプ | タスクの説明 | 指標 | APO の改善 |

| トピック分類 | テキスト分類 | ニュース記事を金融、スポーツなどのトピックに分類する | 精度 | +5% |

| インテント分類 | テキスト分類 | カスタマー サービスのクエリをインテントに分類する | 精度 | +8.0% |

| ウェブページの翻訳 | テキスト翻訳 | ウェブページを英語からローカル言語に翻訳する | BLEU | +8.57% |

シームレスなエンドツーエンドのデベロッパー ワークフロー

ファインチューニングは常にプロンプトよりも品質が向上するという誤解がよくあります。Gemini Nano v3 などの最新の基盤モデルでは、プロンプト エンジニアリング自体が影響を与える可能性があります。

- 一般的な機能の維持: ファインチューニング(PEFT/LoRA)では、モデルの重みが特定のデータ分布に過度にインデックス化されます。これにより、「壊滅的な忘却」が発生することがよくあります。つまり、モデルは特定の構文では優れていますが、一般的なロジックと安全性では劣ります。APO は重みを変更せず、基盤モデルの機能を維持します。

- 命令の追跡と戦略の発見: Gemini Nano v3 は、複雑なシステム命令に従うように厳密にトレーニングされています。APO は、モデルの潜在的な機能を解放する正確な命令構造を見つけることで、この機能を活用します。多くの場合、人間のエンジニアが見つけるのが難しい戦略を発見します。

このアプローチを検証するため、さまざまな本番環境ワークロードで APO を評価しました。検証の結果、さまざまなユースケースで精度が 5 ~ 8% 向上 していることがわかりました。デプロイされた複数のオンデバイス機能で、APO により品質が大幅に向上しました。

まとめ

自動プロンプト最適化(APO) のリリースは、オンデバイス生成 AI の転換点となります。基盤モデルとエキスパート レベルのパフォーマンスのギャップを埋めることで、デベロッパーはより堅牢なモバイル アプリケーションを構築するためのツールを利用できるようになります。ゼロショット最適化 から始める場合でも、データドリブン の改善で本番環境にスケーリングする場合でも、高品質のオンデバイス インテリジェンスへの道筋が明確になりました。ML Kit の Prompt API と Vertex AI の自動プロンプト最適化を使用して、オンデバイスのユースケースを今すぐ本番環境にリリースしましょう。

関連リンク:

続きを読む

-

プロダクト ニュース

Google は、最も高性能な AI モデルをポケットの Android デバイスに直接提供することに取り組んでいます。このたび、最新の最先端オープンモデルである Gemma 4 のリリースを発表いたします。

Caren Chang, David Chou • 3 分で読了

-

2025 年 10 月 30 日2025 年 10 月 30 日

プロダクト ニュース

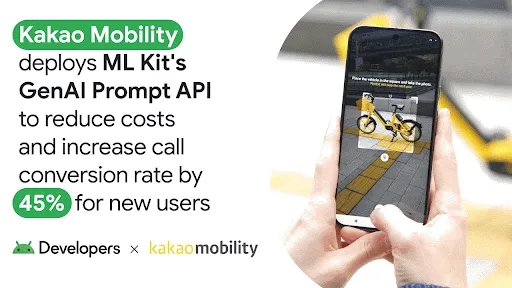

AI により、コンテンツをユーザーに適した形式に変換するパーソナライズされたアプリ エクスペリエンスを簡単に作成できるようになりました。以前は、要約や画像の説明など、特定のユースケース向けに調整された ML Kit GenAI API を通じて、デベロッパーが Gemini Nano と統合できるようにしていました。

Caren Chang, Chengji Yan, Penny Li • 2 分で読了

-

プロダクト ニュース

Google I/O 2026 では、Android がオペレーティング システムからインテリジェンス システムに移行したことを発表しました。また、システムでネイティブにインテリジェント エクスペリエンスを構築し、Google の AI のパワーをアプリに組み込む方法についても説明しました。

Jingyu Shi • 2 分で読了

最新情報の入手

Android 開発に関する最新の分析情報を毎週メールでお届けします。