Duże modele językowe (LLM) różnią się możliwościami. Aby zapewnić Ci kontrolę i elastyczność w zakresie tworzenia oprogramowania z pomocą AI, Android Studio umożliwia wybór modelu lokalnego działającego na Twoim komputerze osobistym, który będzie obsługiwać funkcje AI w IDE.

Wybierz model

Model lokalny jest alternatywą dla obsługi LLM wbudowanej w Android Studio, ale Gemini w Android Studio zwykle zapewnia najlepsze wrażenia związane z AI dla programistów Androida ze względu na zaawansowane modele Gemini. Do zadań związanych z tworzeniem aplikacji na Androida możesz wybrać różne modele Gemini, w tym bezpłatny model domyślny lub modele, do których dostęp uzyskasz za pomocą płatnego klucza Gemini API.

Możliwość korzystania z modelu lokalnego to świetna opcja, jeśli musisz pracować w trybie offline, przestrzegać ścisłych zasad firmy dotyczących korzystania z narzędzi AI lub chcesz eksperymentować z modelami badawczymi typu open source.

Wypróbuj model Gemma 4

Jeśli musisz użyć modelu lokalnego, zalecamy wypróbowanie Gemmy 4, najnowocześniejszego modelu lokalnego dostępnego do kodowania agentowego w Android Studio.

Wymagania sprzętowe są następujące: Jeśli masz urządzenie o wysokiej wydajności, zalecamy używanie modelu Gemma 26B MoE.

| Model | Łączna wymagana ilość pamięci RAM | Miejsce na dane |

|---|---|---|

| Gemma E4B | 12 GB | 4 GB |

| Gemma 26B MoE | 24 GB | 17 GB |

Instrukcje pobierania i uruchamiania modelu Gemma 4 lokalnie na komputerze znajdziesz w przewodniku po konfiguracji.

Konfigurowanie obsługi modelu lokalnego

Pobierz i zainstaluj najnowszą wersję Androida Studio.

Zainstaluj na komputerze lokalnym dostawcę LLM, np. LM Studio lub Ollama.

Dodaj dostawcę modelu do Android Studio.

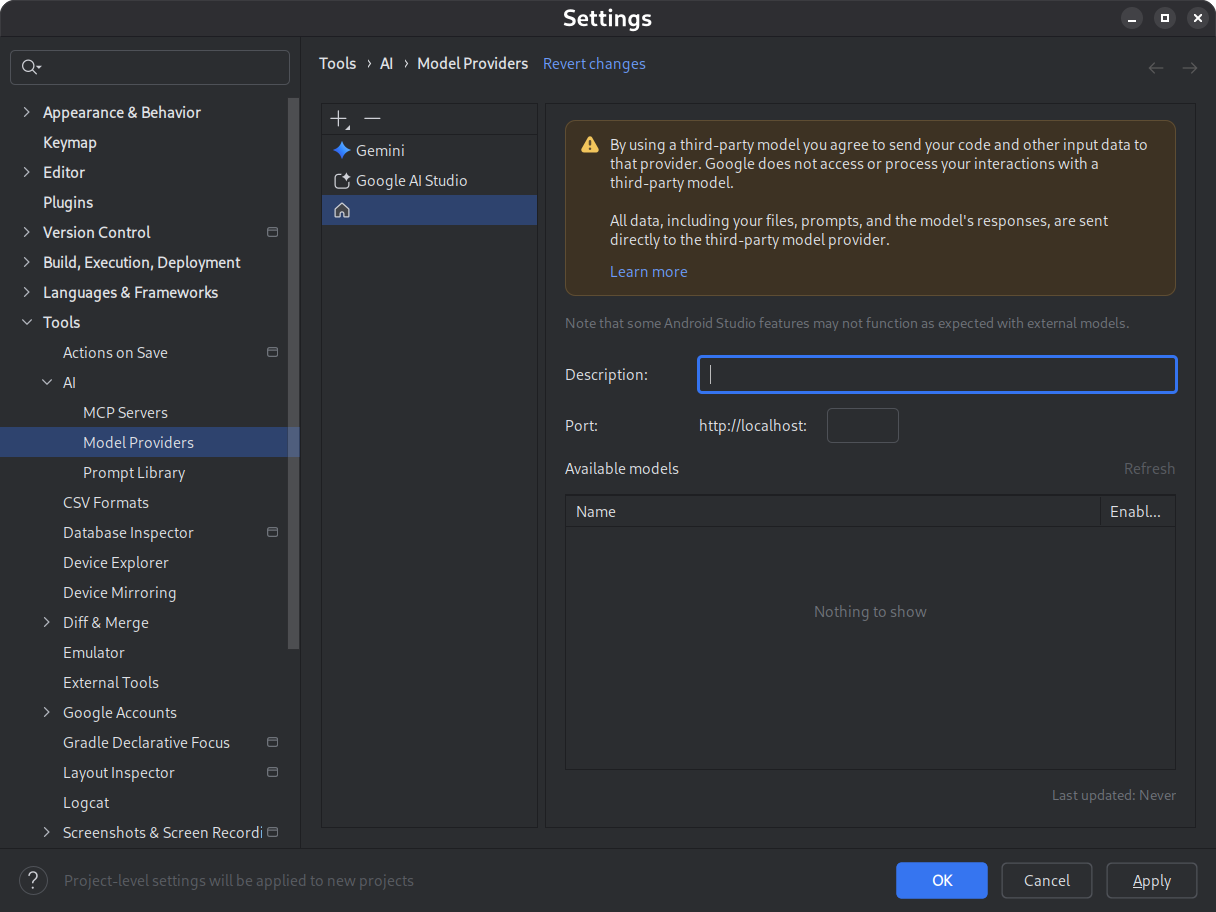

- Otwórz Ustawienia > Narzędzia > AI > Dostawcy modeli.

- Kliknij ikonę .

- Wybierz Lokalny dostawca.

- Wpisz opis dostawcy modelu (zwykle nazwę dostawcy modelu).

- Ustaw port, na którym nasłuchuje dostawca

- Włączanie modelu

Rysunek 1. Ustawienia dostawcy modelu. Pobierz i zainstaluj wybrany model.

Zapoznaj się z katalogami modeli LM Studio i Ollama. Aby w pełni korzystać z trybu agenta w Android Studio, wybierz model wytrenowany pod kątem korzystania z narzędzi.

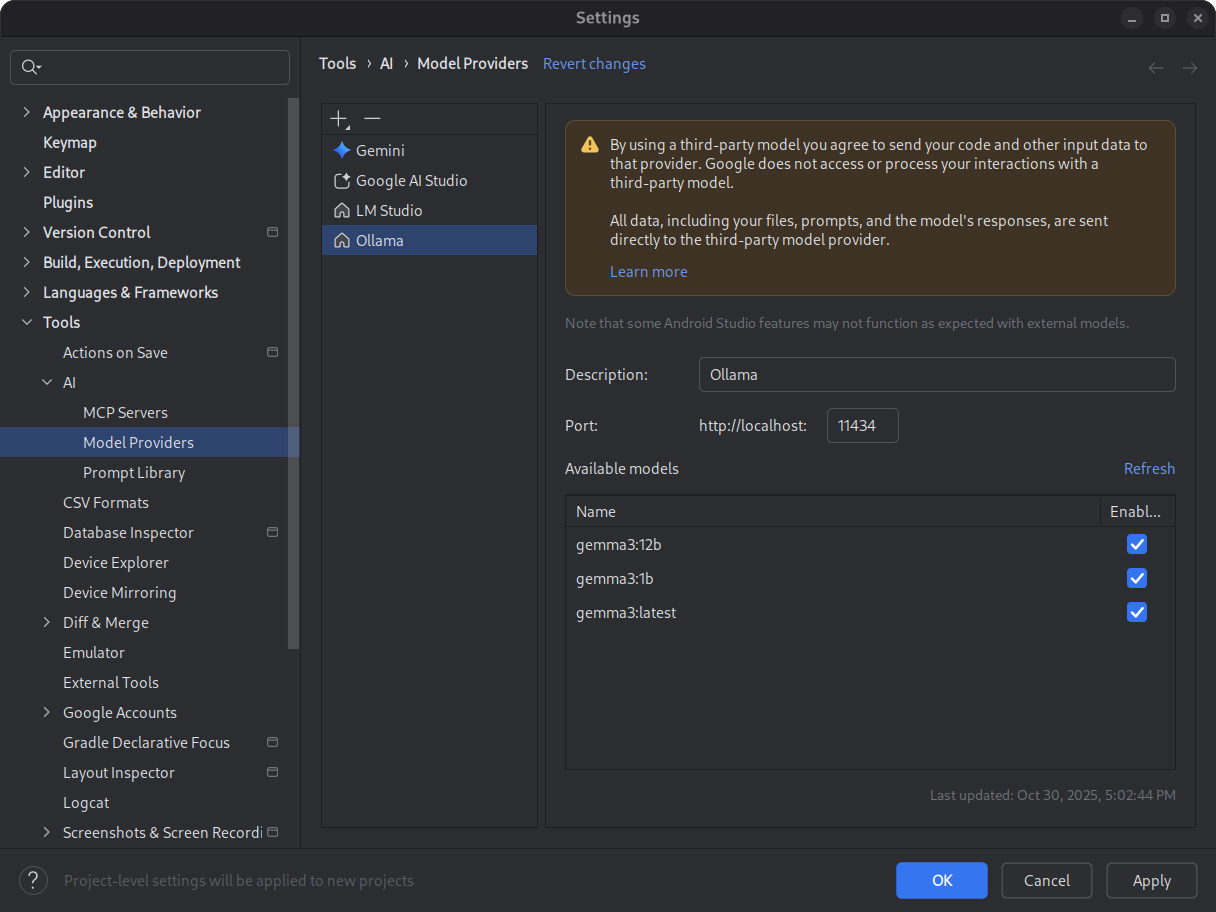

Rysunek 2. Dostępne modele lokalne. Uruchom środowisko wnioskowania.

Środowisko wnioskowania udostępnia model aplikacjom lokalnym. Skonfiguruj wystarczająco duże okno tokenów o długości kontekstu, aby uzyskać optymalną wydajność. Szczegółowe instrukcje dotyczące uruchamiania i konfigurowania środowiska znajdziesz w dokumentacji Ollamy lub LM Studio.

Wybierz model.

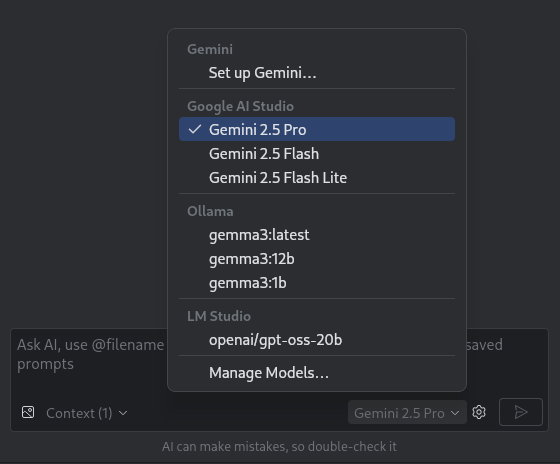

Otwórz Android Studio. Przejdź do okna rozmowy z Gemini. Użyj selektora modeli, aby przełączyć się z domyślnego modelu Gemini na skonfigurowany model lokalny.

Rysunek 3. menu modeli

Po połączeniu Androida Studio z modelem lokalnym możesz korzystać z funkcji czatu w środowisku IDE. Wszystkie interakcje są w pełni obsługiwane przez model działający na komputerze lokalnym, co zapewnia samodzielne środowisko programistyczne AI.

Weź pod uwagę ograniczenia wydajności

Lokalny model offline zwykle nie jest tak wydajny ani inteligentny jak modele Gemini oparte na chmurze. Odpowiedzi na czacie z modeli lokalnych są zwykle mniej dokładne i mają większe opóźnienie w porównaniu z modelami opartymi na chmurze.

Modele lokalne zwykle nie są dostrajane pod kątem programowania na Androida, dlatego mogą zwracać odpowiedzi, które nie uwzględniają interfejsu użytkownika Android Studio. Niektóre funkcje AI w Androidzie Studio i przypadki użycia związane z programowaniem na Androida nie działają z modelem lokalnym. Funkcja czatu AI w Android Studio jest jednak ogólnie obsługiwana przez modele lokalne.

Aby szybko i dokładnie uzyskiwać odpowiedzi na pytania dotyczące wszystkich aspektów tworzenia aplikacji na Androida i korzystania ze wszystkich funkcji Android Studio, używaj Gemini w Android Studio, czyli narzędzia opartego na modelach Gemini.