Les grands modèles de langage (LLM) diffèrent dans leurs capacités. Pour vous offrir contrôle et flexibilité dans le développement de logiciels assisté par IA, Android Studio vous permet de choisir un modèle local, exécuté sur votre machine personnelle, pour alimenter la fonctionnalité d'IA de l'IDE.

Choisir un modèle

Un modèle local offre une alternative à la prise en charge des LLM intégrée à Android Studio. Toutefois, Gemini dans Android Studio offre généralement la meilleure expérience d'IA aux développeurs Android grâce aux puissants modèles Gemini. Vous pouvez choisir parmi différents modèles Gemini pour vos tâches de développement Android, y compris le modèle par défaut sans frais ou les modèles accessibles avec une clé API Gemini payante.

La fonctionnalité de modèle local est une excellente option si vous devez travailler hors connexion, si vous devez respecter des règles d'entreprise strictes concernant l'utilisation des outils d'IA ou si vous souhaitez expérimenter des modèles de recherche Open Source.

Essayer le modèle Gemma 4

Si vous devez utiliser un modèle local, nous vous recommandons d'essayer Gemma 4, un modèle local de pointe disponible pour le codage agentique dans Android Studio.

Voici la configuration matérielle requise. Nous vous recommandons d'utiliser le modèle Gemma 26B MoE si vous disposez d'une machine hautes performances.

| Modèle | RAM totale requise | Stockage |

|---|---|---|

| Gemma E4B | 12 Go | 4 Go |

| Gemma 26B MoE | 24 Go | 17 Go |

Consultez le guide de configuration pour savoir comment télécharger et exécuter Gemma 4 localement sur votre machine.

Configurer la prise en charge des modèles locaux

Téléchargez et installez la dernière version d'Android Studio.

Installez un fournisseur de LLM tel que LM Studio ou Ollama sur votre ordinateur local.

Ajoutez le fournisseur de modèle à Android Studio.

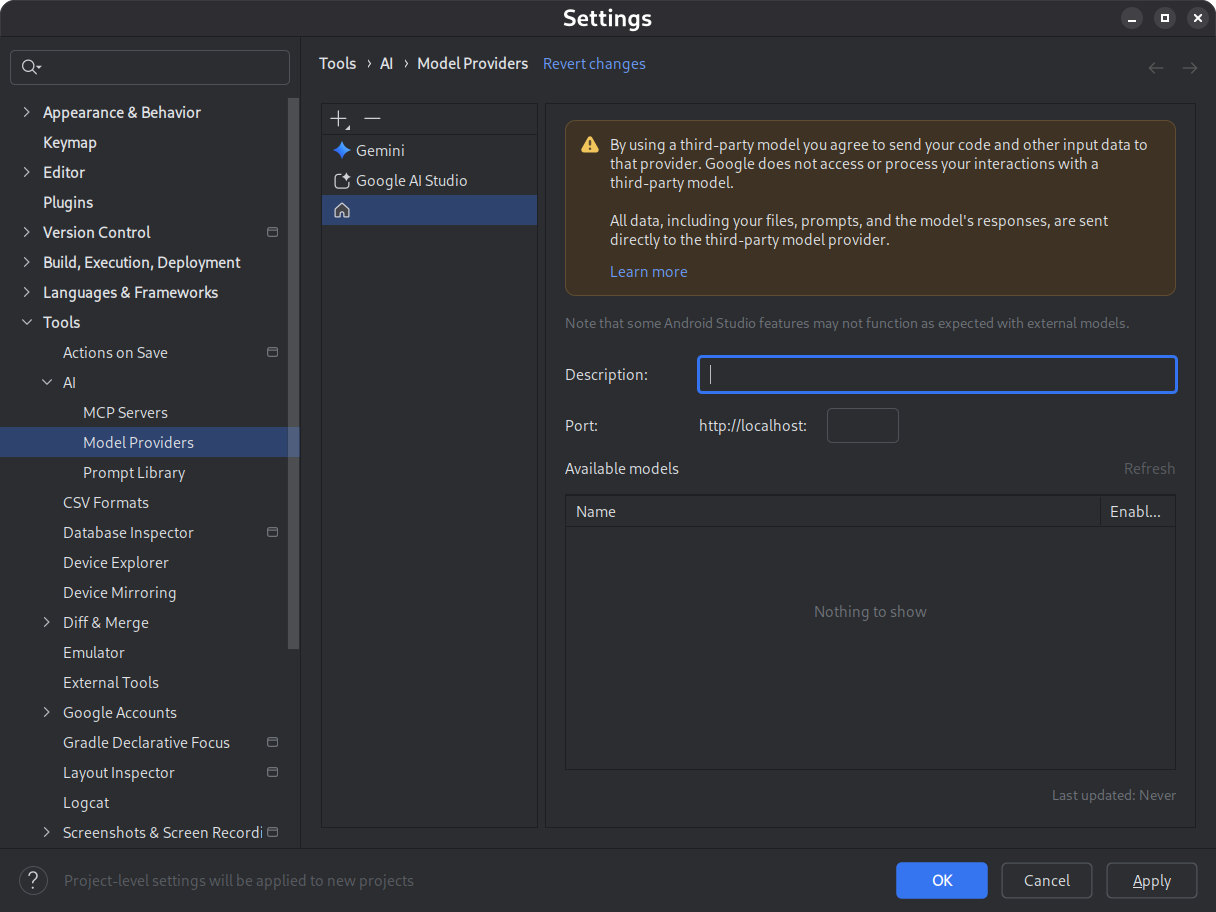

- Accédez à Settings > Tools > AI > Model Providers (Paramètres > Outils > IA > Fournisseurs de modèles).

- Sélectionnez l'icône .

- Sélectionnez Local Provider (Fournisseur local).

- Saisissez une description du fournisseur de modèle (généralement le nom du fournisseur de modèle).

- Définissez le port sur lequel le fournisseur écoute.

- Activez un modèle.

Figure 1. Paramètres du fournisseur de modèle. Téléchargez et installez le modèle de votre choix.

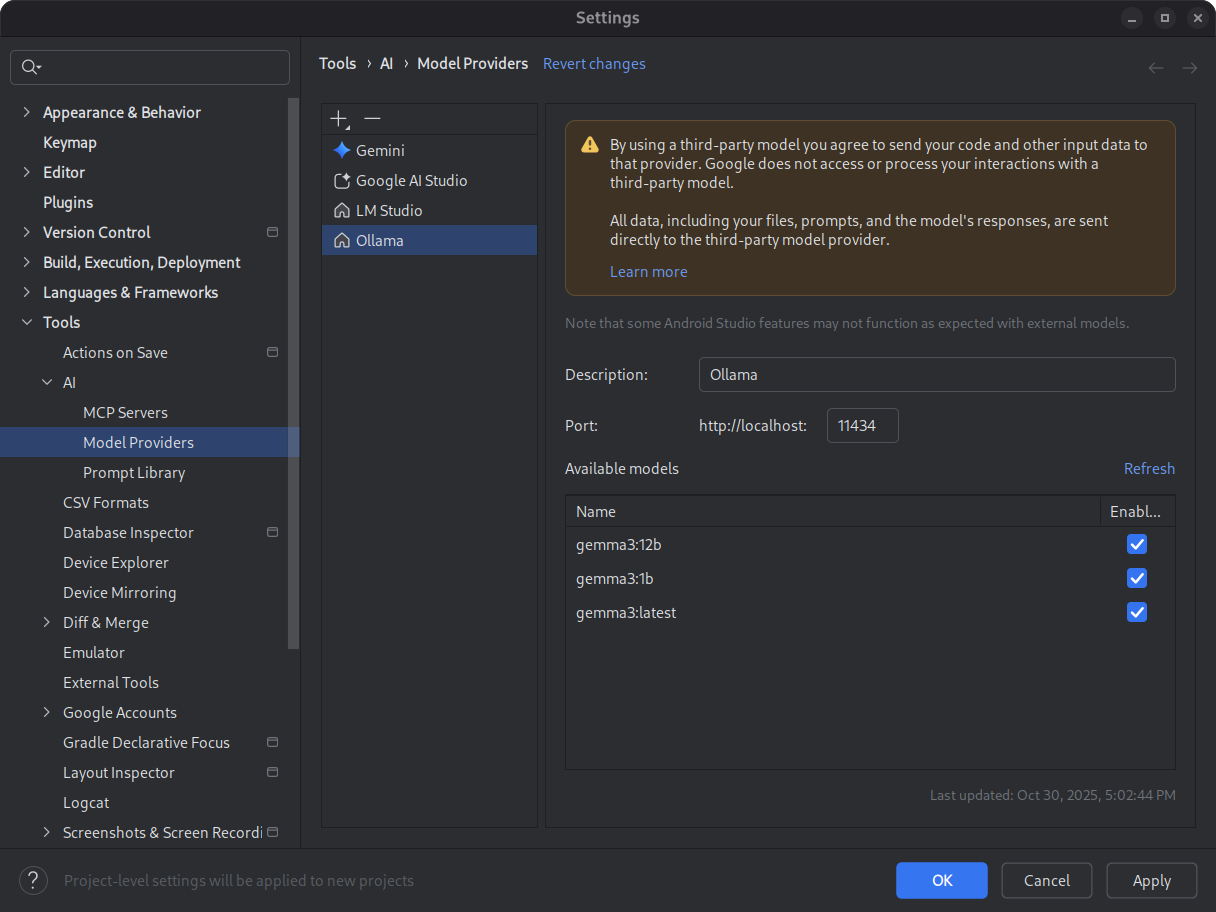

Consultez les catalogues de modèles LM Studio et Ollama. Pour une expérience optimale avec le mode Agent dans Android Studio, sélectionnez un modèle qui a été entraîné pour l'utilisation d'outils.

Figure 2. Modèles locaux disponibles. Démarrez votre environnement d'inférence.

L'environnement d'inférence diffuse votre modèle vers les applications locales. Configurez une fenêtre de jetons de longueur de contexte suffisamment grande pour des performances optimales. Pour obtenir des instructions détaillées sur le démarrage et la configuration de votre environnement, consultez la documentation Ollama ou LM Studio.

Sélectionnez un modèle.

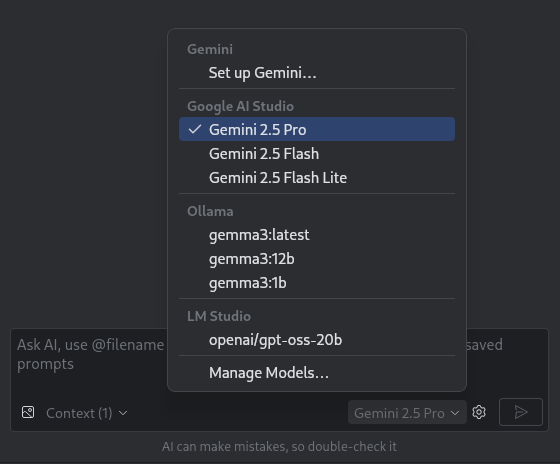

Ouvrez Android Studio. Accédez à la fenêtre de chat Gemini. Utilisez le sélecteur de modèle pour passer du modèle Gemini par défaut au modèle local configuré.

Figure 3. Sélecteur de modèle.

Une fois que vous avez connecté Android Studio à votre modèle local, vous pouvez utiliser les fonctionnalités de chat dans l'IDE. Toutes les interactions sont entièrement alimentées par le modèle exécuté sur votre machine locale, ce qui vous offre un environnement de développement d'IA autonome.

Tenir compte des limites de performances

Un modèle local hors connexion n'est généralement pas aussi performant ni intelligent que les modèles Gemini basés sur le cloud. Les réponses de chat des modèles locaux sont généralement moins précises et présentent une latence plus élevée que celles des modèles basés sur le cloud.

Les modèles locaux ne sont généralement pas affinés pour le développement Android, et ils peuvent renvoyer des réponses qui ne sont pas informées de l'interface utilisateur d'Android Studio. Certaines fonctionnalités d'IA d'Android Studio et certains cas d'utilisation du développement Android ne fonctionnent pas avec un modèle local. Toutefois, la fonctionnalité de chat d'IA dans Android Studio est généralement compatible avec les modèles locaux.

Pour obtenir des réponses rapides et précises sur tous les aspects du développement Android et la prise en charge de toutes les fonctionnalités d'Android Studio, Gemini dans Android Studio, optimisé par les modèles Gemini, est la meilleure solution.