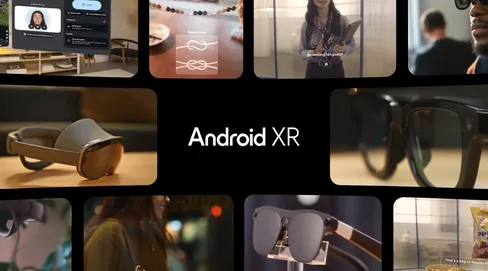

10월에 삼성은 Galaxy XR - Android XR을 기반으로 하는 최초의 기기를 출시했습니다. 그리고 일부 개발자가 빌드한 결과물을 보니 정말 놀라웠습니다. 다음은 Android XR 여정에 관해 일부 개발자가 말한 내용입니다.

Android XR은 앱을 빌드할 수 있는 완전히 새로운 세계를 열어주었습니다. 팀은 다음과 같은 질문을 스스로에게 던져야 합니다. 빌드할 수 있는 가장 크고 대담한 버전의 환경은 무엇인가요? 이제 실현할 수 있는 플랫폼이 있으므로 항상 하고 싶었던 일을 실행할 수 있는 기회입니다. - Kristen Coke, Calm, 리드 제품 관리자

또한 XREAL의 Project Aura, Gentle Monster 및 Warby Parker의 세련된 글라스와 같이 Android XR과 호환되는 다른 출시 예정 기기의 첫 번째 모습도 공유했습니다.

확장되는 XR 기기 선택을 지원하기 위해 Android XR SDK 개발자 프리뷰 3 를 발표합니다.

Android XR SDK 개발자 프리뷰 3를 사용하면 Galaxy XR과 같은 기기를 위한 몰입형 환경을 빌드하는 것 외에도 이제 Android XR이 탑재된 출시 예정 AI 안경을 위한 증강 환경을 빌드할 수 있습니다.

증강 환경을 위한 새로운 도구 및 라이브러리

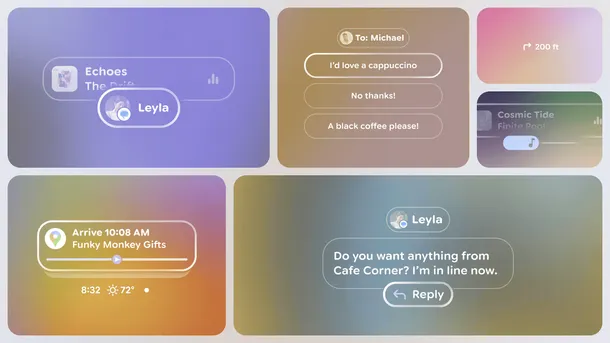

개발자 프리뷰 3를 사용하면 AI 안경을 위한 지능형 핸즈프리 증강 환경을 빌드하는 데 필요한 도구와 라이브러리를 활용할 수 있습니다. AI 안경은 하루 종일 착용할 수 있도록 가볍고 휴대하기 편리합니다. 기존 모바일 앱을 확장하여 내장 스피커, 카메라, 마이크를 활용하여 새롭고 사려 깊고 유용한 사용자 상호작용을 제공할 수 있습니다. 디스플레이 AI 안경에 작은 디스플레이를 추가하면 사용자에게 정보를 비공개로 제공할 수 있습니다. AI 안경은 사용자가 현실 세계에서 집중력과 존재감을 높이는 데 도움이 되는 환경에 적합합니다.

AI 안경에서 증강 환경을 지원하기 위해 Jetpack XR SDK에 두 가지 새로운 맞춤형 라이브러리를 도입합니다.

- Jetpack Projected - 안경의 센서, 스피커, 디스플레이에 액세스할 수 있는 기능을 통해 모바일 기기와 AI 안경을 연결하도록 빌드됨

- Jetpack Compose Glimmer - 디스플레이 AI 안경에서 증강 환경을 제작하고 스타일을 지정하기 위한 새로운 디자인 언어 및 UI 구성요소

Jetpack Compose Glimmer는 아름다운 광학 시스루 증강 환경을 위한 디자인 권장사항을 보여줍니다. 디스플레이 AI 안경의 입력 방식 및 스타일 지정 요구사항에 최적화된 UI 구성요소를 갖춘 Jetpack Compose Glimmer는 명확성, 가독성, 최소한의 방해를 위해 설계되었습니다.

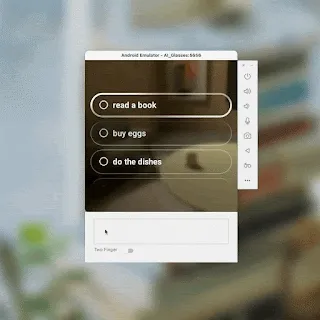

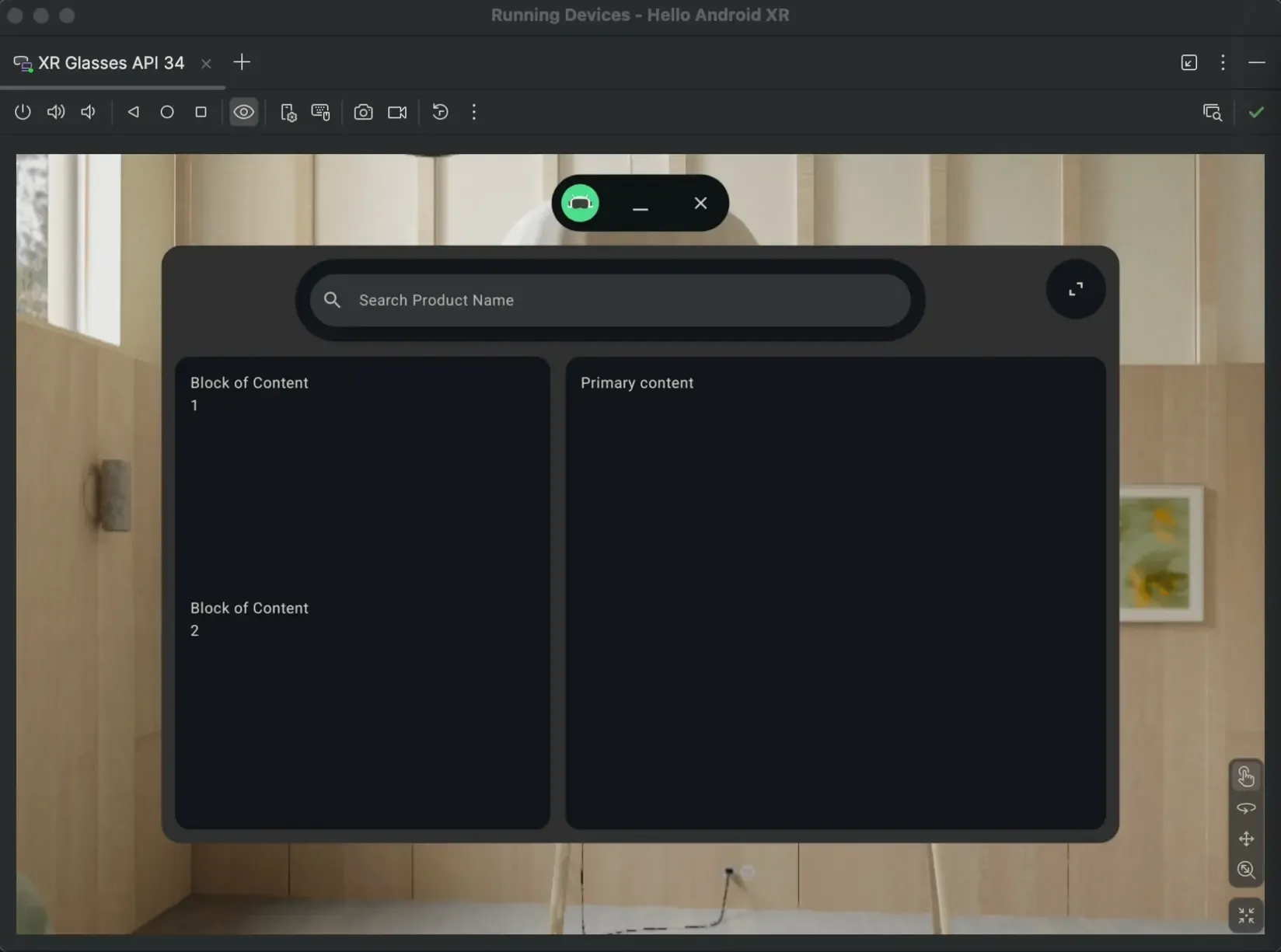

Jetpack Compose Glimmer UI를 시각화하고 테스트할 수 있도록 Android 스튜디오에 AI 안경 에뮬레이터를 도입합니다. 새로운 AI 글라스 에뮬레이터는 터치패드 및 음성 입력과 같은 글라스 관련 상호작용을 시뮬레이션할 수 있습니다.

새로운 Jetpack Projected 및 Jetpack Compose Glimmer 라이브러리 외에도 AI 안경을 지원하도록 Jetpack XR용 ARCore 를 확장하고 있습니다. 증강 환경을 위한 모션 추적 및 지리공간 기능부터 시작합니다. 이러한 기능은 AI 글라스와 같은 하루 종일 착용하는 기기에 적합한 유용한 탐색 환경을 만들 수 있도록 지원합니다.

몰입형 환경 지원 확대

삼성 Galaxy XR과 같은 XR 헤드셋 및 XREAL의 출시 예정 Project Aura와 같은 유선 XR 안경 의 몰입형 환경을 지원하는 라이브러리와 도구에 계속 투자하고 있습니다. 개발자 프리뷰 2 이후로 Jetpack XR SDK 에 요청이 많은 여러 기능을 추가했습니다.

Jetpack SceneCore 는 이제 URI를 통한 동적 glTF 모델 로드 및 개선된 소재 지원을 통해 런타임에 새로운 PBR 소재를 만들 수 있습니다. 또한 SurfaceEntity 구성요소는 전체 Widevine 디지털 권한 관리 (DRM) 지원과 새로운 도형으로 향상되어 구와 반구에서 360도 및 180도 동영상을 렌더링할 수 있습니다.

XR용 Jetpack Compose에는 사용자가 어디를 보든 콘텐츠가 사용자의 시야에 유지되도록 하는 따라가기 동작을 위한 UserSubspace 구성요소와 같은 새로운 기능이 있습니다. 또한 이제 공간 애니메이션을 사용하여 슬라이딩 또는 페이딩과 같은 부드러운 전환을 할 수 있습니다. 다양한 디스플레이 기능을 갖춘 몰입형 기기의 확장되는 생태계를 지원하기 위해 이제 레이아웃 크기를 사용자가 편안하게 볼 수 있는 시야의 비율로 지정할 수 있습니다.

XR용 Material Design에서는 새로운 구성요소가 재정의를 통해 공간적으로 자동으로 조정됩니다. 여기에는 공간적으로 상승하는 대화상자와 Orbiter로 튀어나오는 탐색 메뉴가 포함됩니다. 또한 전체 공간으로 쉽게 전환할 수 있는 새로운 SpaceToggleButton 구성요소가 있습니다.

Jetpack XR용 ARCore에는 68개의 블렌드셰이프 값으로 얼굴을 추적하여 다양한 얼굴 표정을 활용할 수 있는 얼굴 추적을 비롯한 새로운 인식 기능이 추가되었습니다. 또한 눈 추적을 사용하여 가상 아바타를 지원하고 깊이 지도를 사용하여 사용자 환경과의 상호작용을 더 현실적으로 만들 수 있습니다.

XREAL의 Project Aura와 같은 기기의 경우 Android 스튜디오에 XR 안경 에뮬레이터를 도입합니다. 이 필수 도구는 시야 (FoV), 해상도, DPI에 대한 실제 기기 사양과 일치하면서 정확한 콘텐츠 시각화를 제공하여 개발 속도를 높이도록 설계되었습니다.

Unity로 몰입형 환경을 빌드하는 경우 Unity용 Android XR SDK 에서 인식 기능도 확장됩니다. 많은 버그 수정 및 기타 개선사항 외에도 QR 및 ArUco 코드, 평면 이미지, 바디 트래킹 (실험용)을 포함하도록 트래킹 기능을 확장하고 있습니다. 또한 요청이 많은 기능인 장면 메시를 도입합니다. 이를 통해 사용자 환경과 훨씬 더 깊이 상호작용할 수 있습니다. 이제 디지털 콘텐츠가 벽에서 튕겨 나가고 소파를 올라갈 수 있습니다.

지금까지 소개한 내용은 빙산의 일각에 불과합니다. 자세한 내용은 몰입형 환경 페이지를 참고하세요.

지금 시작해 보세요!

Android XR SDK 개발자 프리뷰 3를 이제 이용하실 수 있습니다. 최신 Android 스튜디오 Canary (Otter 3, Canary 4 이상)를 다운로드하고 최신 에뮬레이터 버전 (36.4.3 Canary 이상)으로 업그레이드한 후 developer.android.com/xr을 방문하여 증가하는 Android XR 기기 선택을 위해 빌드하는 데 필요한 최신 라이브러리 및 샘플을 시작하세요. Google은 개발자와 함께 Android XR을 빌드하고 있습니다. Android XR 여정을 진행하면서 의견, 제안, 아이디어를 Google팀과 공유해 주세요.

계속 읽기

-

2026년 5월 19일2026년 5월 19일

제품 소식

Google I/O '26에는 에이전트 기반 생산성, UI 표준으로서의 Compose First, 확장되는 생태계를 위한 고성능 미디어 및 적응형 개발에 중점을 둔 Android 개발자를 위한 17가지 주요 발표가 포함되어 있습니다.

Matthew McCullough • 8분 읽기

-

2026년 5월 12일2026년 5월 12일

제품 소식

오늘 The Android Show에서 발표된 Android는 운영체제에서 인텔리전스 시스템으로 전환하여 앱과의 참여 기회를 더 많이 창출하고 있습니다.

Matthew McCullough • 읽는 데 4분 소요

-

제품 소식

오늘 Google은 복잡한 추론 및 자율 도구 호출 기능을 갖춘 최신 최첨단 개방형 모델인 Gemma 4로 Android 개발을 개선하고 있습니다.

Matthew McCullough • 2분 읽기

소식 받아보기

Android 개발 관련 최신 정보를 이메일로 받아 보세요. 매주